netzpolitik.org

Bitte aktualisieren Sie PHP auf Version 8.2.0 (zurzeit: 8.1.2-1ubuntu2.24). Info

Der Meta-Konzern hat mit seinem KI-Support eine deftige Sicherheitslücke aufgemacht. Angreifer konnten fremde Instagram-Accounts übernehmen, ohne Zugriff auf die originale Mailadresse des Kontos zu haben.

Einfacher geht’s kaum: Hacker:innen haben den KI-gestützten Support-Chatbot von Meta genutzt, um sich Zugang zu Profilen auf der Plattform Instagram zu verschaffen, berichtet das Online-Medium 404. Betroffen von dem Angriff waren unter anderem das White-House-Profil von Barack Obama und ein Account eines ranghohen Offiziers der US Space Force. Auch ganz normale Nutzer:innen waren von Account-Übernahmen betroffen.

Meta hat die Sicherheitslücke mittlerweile bestätigt und nach eigenen Angaben behoben. Es ist nicht bekannt, wie viele Accounts mit dieser Methode übernommen wurden.

In einem Video, das in sozialen Medien kursierte, wird klar, wie simpel der Angriff funktionierte. Der Angreifer täuschte mit einem VPN vor, aus der Region des Ziel-Accounts zu stammen und nutzte dann die „Passwort vergessen“-Funktion. Danach gab er dem Meta-Chatbot eine neue Mailadresse für den fremden Account und forderte den Bot auf, mit dieser zu kommunizieren. An diese Adresse schickte Meta dann fahrlässigerweise einen Verifikationscode, mit dem der Angreifer den anvisierten Instagram-Account übernehmen konnte.

Zu keinem Zeitpunkt musste der Angreifer Zugriff auf die echte Mailadresse des Accounts haben. Die Nutzung der originalen Mailadresse soll grundlegend vor Accountübernahmen schützen, da sich Angreifer in der Regel Zugriff auf diese Adressen verschaffen müssen. Hilfreich gegen Account-Übernahmen ist auch die Aktivierung einer weiter gehenden 2‑Faktor-Authentifizierung.

Der Vorfall zeigt einmal mehr, dass so genannte Künstliche Intelligenz nicht nur Sicherheitslücken entdecken, sondern selbst grobe Sicherheitslücken eröffnen kann. Meta hatte den „KI Support Assistenten“ weltweit am Anfang dieses Jahres für Facebook und Instagram eingeführt.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die Werbeindustrie hat den größten Überwachungsapparat der Geschichte geschaffen. Jetzt zeigt unsere neue Recherche: Auch die deutsche Polizei bedient sich daran und unterläuft dabei den Rechtsstaat. So schafft man Unsicherheit im Namen der Sicherheit. Ein Kommentar.

Donald Trumps Abschiebemiliz ICE tut es, ungarische Behörden unter Viktor Orbán taten es und jetzt steht fest: Auch die deutsche Polizei hat Daten aus dem Ökosystem der Online-Werbung für heimliche Überwachung genutzt. Vermutet worden war das schon länger, dank unserer neuen IFG-Recherche mit dem Bayerischen Rundfunk haben wir es erstmals Schwarz auf Weiß: Mindestens in Mecklenburg-Vorpommern ist es passiert. Vielleicht auch in Brandenburg, das dortige Landeskriminalamt will auch auf Nachfrage nicht sagen, auf welche Art kommerzieller Daten von Databrokern es zurückgreift.

Zu den polizeilich genutzten Datensätzen aus der digitalen Werbeindustrie können unter anderem metergenaue Standortdaten von Handys gehören. Sie werden von Tracking-Firmen aus beliebten Apps ohne Wissen der Nutzer:innen abgesaugt und von windigen Databrokern an potenziell alle verkauft, die danach fragen.

Zahlreiche Recherchen zeigen: Dass solche Daten frei verfügbar sind, ist eine Gefahr, etwa für bedrohte Journalist:innen oder queere Menschen, für die nationale Sicherheit oder die der EU. In den USA gibt es Hinweise, dass Standortdaten der Werbeindustrie US-Soldat:innen zur Zielscheibe gemacht haben.

Hinzu kommt, dass die Daten, nach allem, was wir wissen, überwiegend illegal fließen. Von der Erhebung über den Handel bis zur Verwendung dürfte jedes Glied dieser Datenlieferkette gegen die Datenschutzgrundverordnung (DSGVO) verstoßen. Mindestens das Landeskriminalamt von Mecklenburg-Vorpommern muss sich den Vorwurf gefallen lassen, dass es auf einem Daten-Schwarzmarkt mitgemischt hat. Ob und wie viel Geld geflossen ist, verrät es nicht.

Wo ein Trog ist, da sammeln sich Schweine

Überhaupt mauern deutsche Behörden bei diesem Thema, wo es nur geht. Nutzt die Polizei wirklich nur in zwei Bundesländern Daten von Databrokern? Neun LKAs verweigerten die Auskunft gleich ganz – unter Verweis auf den Schutz der Polizeiarbeit. Der Verdacht liegt nahe, dass sie etwas zu verbergen haben.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Während US-Behörden ihre Geschäftsbeziehungen zu kommerziellen Datenfirmen wie selbstverständlich offenlegen, können wir hierzulande nicht mal eine Debatte darüber führen, ob und unter welchen Umständen werbebasierte Überwachung zu unserem Verständnis vom Rechtsstaat passt. Auch die Bundesregierung verweigerte dem Parlament im Dezember Informationen zu dem Thema, selbst in eingestufter Form.

Dabei ist der Missbrauch von angeblich nur für Werbezwecke erhobenen Daten durch Polizeibehörden und Geheimdienste nur die neuste Stufe einer längeren Entwicklung: Die vermeintlich harmlose Welt der kommerziellen Datensammlung verschmilzt mit staatlicher Überwachung.

Bereits die Snowden-Leaks hatten gezeigt, dass US-Geheimdienste in großem Stil auf Daten zugreifen, die etwa bei kommerziellen E‑Mail-Anbietern wie Google oder Yahoo anfallen. Heute können staatliche Stellen auf ein wachsendes Netz privater Überwachungskameras zugreifen, mit KI-Gesichtserkennung Menschen auf Fotos in Sozialen Netzwerken aufspüren und mit Hilfe privater Anbieter wie Palantir Verdächtige aus riesigen Datenmengen generieren.

Und jetzt also ADINT, kurz für Advertising-based Intelligence, werbebasierte Aufklärung. Eigentlich keine Überraschung: Die Werbeindustrie hat den größten Überwachungsapparat der Geschichte geschaffen. Es war nur eine Frage der Zeit, bis sich daran auch andere gütlich tun. Wer sich schon länger mit den Begehrlichkeiten von einmal erhobenen Daten beschäftigt, kennt den Spruch: Wo ein Trog ist, sammeln sich Schweine.

Datensparsamkeit nur bei Medienanfragen

Dass deutsche Polizeibehörden darüber lieber nicht sprechen, hat wohl einen Grund: Nach Einschätzung von Jurist:innen fehlt ihnen eine rechtliche Grundlage, um kommerziell erhobene Daten aus der Werbeindustrie zu nutzen. Auf Generalklauseln können sie sich jedenfalls nicht stützen, sagen Datenschutzbehörden.

Das Zusammenwachsen von Überwachungskapitalismus und Überwachungsstaat stellt die Wirksamkeit unseres Rechtsstaats auf die Probe. Wenn sie beispielsweise Menschen mit Funkzellenabfragen orten wollen, brauchen Polizeibehörden dafür eine richterliche Genehmigung. Diesen Umweg, der den Schutz von Grundrechten sicherstellen und Überwachungsexzesse verhindern soll, will sich die Polizei offenbar gerne sparen.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Deshalb müssen wir jetzt nicht nur auf Transparenz und eine politische Debatte drängen, sondern auch auf strenge Regeln. Im besten Fall verbieten wir Behörden die Nutzung von illegal erhobenen Werbedaten.

Man muss sich das vor Augen halten: In den USA jagt ICE Menschen, vermutlich auch mit Hilfe von Werbedaten. Die Regierung von Viktor Orbán könnte sie gegen Oppositionelle genutzt haben. Expert:innen warnen davor, dass feindliche Geheimdienste und Militärs sie gegen die EU einsetzen könnten. Und deutsche Polizist:innen – machen einfach auch mit. Hallo, geht’s noch?

Wir brauchen keine Polizeibehörden, die nur bei ihren Antworten auf Presseanfragen Datensparsamkeit praktizieren, aber bei neuartigen Überwachungsmethoden aus dem Vollen schöpfen wollen. Der Staat sollte uns vor Tracking-Firmen und Datenhändlern schützen, nicht mit ihnen Geschäfte machen.

Korrektur, 2. Juni, 12:00 Uhr: Aus den Antworten des LKA Brandenburg geht nicht klar hervor, ob die von Datenhändlern beschafften kommerziellen Daten aus der Werbe-Industrie stammen oder möglicherweise aus Quellen außerhalb der Werbe-Industrie. Auch auf direkte Nachfrage hat die Behörde das nicht offengelegt. Das war nicht sauber formuliert. Wir haben das korrigiert.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

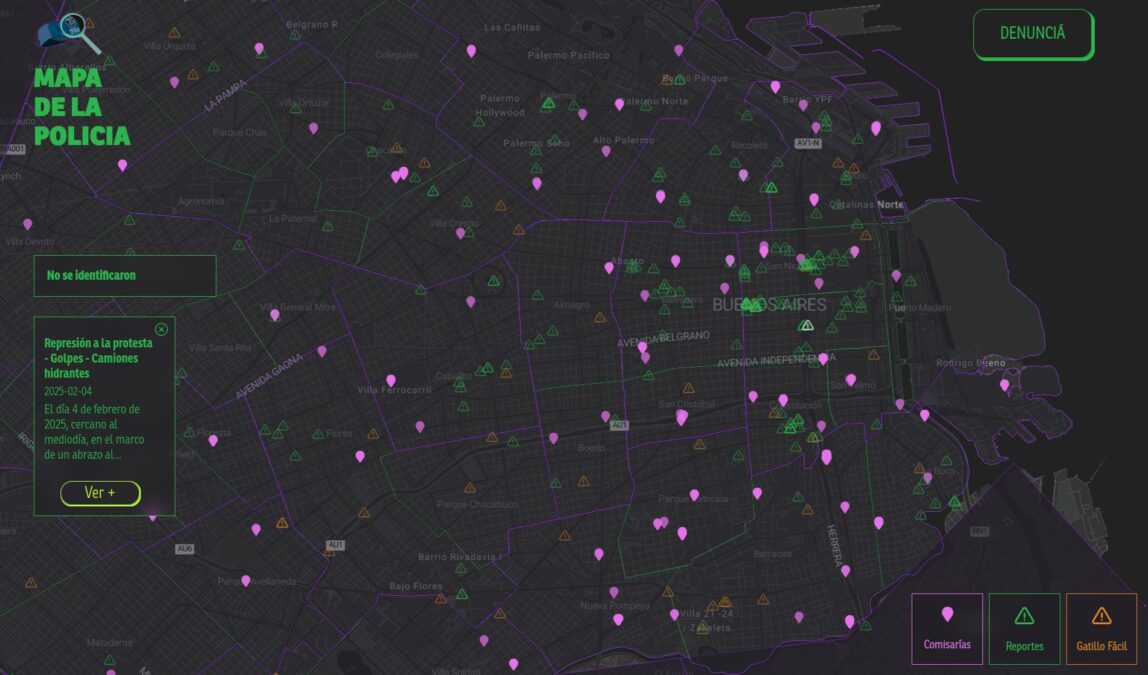

In mindestens zwei Bundesländern hat sich die Polizei Daten von Databrokern beschafft, wie Recherchen von netzpolitik.org und BR erstmals zeigen. Mit solchen Daten könnten sich Handys metergenau orten lassen. Fachleute halten das für illegal, eine Datenschutzbehörde hat sich bereits eingeschaltet.

Fachleute haben es schon vermutet, jetzt belegen Recherchen von netzpolitik.org und Bayerischem Rundfunk exklusiv: Auch in Deutschland nutzt die Polizei Daten der Werbe-Industrie. Mindestens zwei Landeskriminalämter haben sich von kommerziellen Anbietern Daten beschafft.

Dahinter steckt das oftmals illegale Geschäft der Databroker. Erhoben werden solche Daten etwa angeblich zu Werbezwecken, doch über Databroker werden sie zur Handelsware. In die Hände der Datenhändler gelangen sie über Tracking-Firmen, abgesaugt von populären Apps – und in der Regel ohne Wissen der Betroffenen.

Zum Angebot der Databroker gehören auch metergenaue Ortungen, aus denen sich Bewegungsprofile von Handys und ihren Besitzer*innen ablesen lassen: Wohnort, Arbeitsplatz und mehr. Das gefährdet nicht nur die Privatsphäre aller, sondern lässt sich auch für Spionage und Sabotage nutzen. Expert*innen aus Politik und Wissenschaft sehen im Handel mit Standortdaten deshalb eine Gefahr für die nationale Sicherheit.

Dass Polizeibehörden selbst Daten von Databrokern nutzen, war bislang nur von wenigen Staaten bekannt, etwa den USA und seit Kurzem Ungarn. Jetzt haben das auch zwei deutsche Landeskriminalämter bestätigt: Brandenburg und Mecklenburg-Vorpommern. Anlass waren Anfragen nach dem Informationsfreiheitsgesetz (IFG) und Presseanfragen von netzpolitik.org und dem BR.

Ein Geschäft, das Europas Sicherheit bedroht

Möglicherweise nutzen noch mehr deutsche Landespolizeien solche Daten. In neun Bundesländern haben die Behörden eine Auskunft verweigert. Nur in fünf Bundesländern hat die Polizei den Einsatz klar verneint.

In Reaktion auf die Recherche hat der Landesdatenschutzbeauftragte Mecklenburg-Vorpommern eine Prüfung eingeleitet. Weder seine Behörde noch die sonstigen 15 Landesdatenschutzbehörden, die wir angefragt haben, sehen eine konkrete rechtliche Grundlage für die Nutzung von Werbedaten durch die Polizei.

Auch der Polizeirechtler Mark Zöller von der Ludwig-Maximilians-Universität München hält die Praxis für rechtswidrig. Er spricht von einem „wirklich massiven“ Risiko, dass Behörden Daten erhalten, die sie nicht zu sehen bekommen sollten.

Unsere Recherche zeigt: Auf wahrscheinlich illegale Weise unterstützt die Polizei den Schwarzmarkt der Databroker. Damit beteiligen sich deutsche Behörden im Namen der Sicherheit an einem Geschäft, das selbst Europas Sicherheit bedroht. Ob und wie viel Steuergeld dabei geflossen ist, wissen wir jedoch nicht.

Brandenburg „greift auf Datenhändler zurück“

Ein wichtiger Baustein unserer Recherche war eine Liste von sogenannten ADINT-Firmen. ADINT steht für Advertising-based Intelligence, also werbebasierte Aufklärung. Die Liste haben der Tracking-Forscher Wolfie Christl und das Citizen Lab der Universität Toronto bereitgestellt. Sie arbeiten an einer globalen Bestandsaufnahme zum Missbrauch von Werbedaten für Überwachungszwecke. Ihre bislang unveröffentlichten Zwischenergebnisse sind in unsere IFG- und Presseanfragen an deutsche Behörden geflossen.

Die Polizei in Brandenburg antwortete:

Das Landeskriminalamt Brandenburg greift zur Bekämpfung unterschiedlicher Kriminalitätsphänomene bei der Informationsbeschaffung anlassbezogen auch auf Datenhändler oder andere Anbieter kommerziell erwerblicher Daten zurück.

Unter anderem würden „in den Phänomenbereichen Cybercrime und Wirtschaftskriminalität Daten weniger kommerzieller Anbieter erhoben“. Dies diene „in der Regel zur Analyse von Täter- und Tatzusammenhängen“.

Mehr zu den Daten und ihren Quellen, den beteiligten Firmen oder entsprechenden Verträgen wollte die Behörde nicht offenlegen. Das könne „Belange der Strafverfolgung und ‑vollstreckung, der Gefahrenabwehr sowie die Tätigkeit der Polizei beeinträchtigen“. Wir wissen deshalb nicht genau, welche kommerziellen Daten die Polizei in Brandenburg nutzt und ob dazu auch Handy-Standortdaten gehören.

Die Polizei in Mecklenburg-Vorpommern hat unsere IFG-Anfrage so beantwortet:

Im Zusammenhang mit der Bekämpfung von Kriminalität, die im Zuständigkeitsbereich des LKA MV liegt, wie zum Beispiel im Bereich der Bekämpfung von Cybercrime oder auch Wirtschaftskriminalität, erfolgt mitunter die Nutzung von Daten weniger und etablierter kommerzieller Anbieter, insbesondere für eine erste Analyse von Beteiligungen und Verflechtungen.

Erst nach einer weiteren Presseanfrage wurde die Behörde genauer: Zu den Daten gehörten demnach auch Standortdaten der Werbeindustrie. Das LKA legt aber nicht offen, ob es die Daten selbst erworben oder einen ADINT-Dienstleister genutzt hat. Künftig will die Behörde allerdings keine kommerziellen Daten mehr nutzen: Es sei “gegenwärtig und auch zukünftig” nicht vorgesehen.

Mecklenburg-Vorpommern: Datenschutzbehörde prüft

Was sagt die zuständige Datenschutzbehörde zu den Databroker-Deals der Polizei in Mecklenburg-Vorpommern? Das LKA hatte die Behörde „über ein entsprechendes Produkt informiert“, erklärt eine Sprecherin auf Anfrage. Anlass sei ein „regelmäßiger, informeller Austausch“ gewesen. „Bereits in diesem Termin haben wir uns kritisch zum Einsatz und insbesondere Zweifel an einer tragfähigen Rechtsgrundlage geäußert.“

Dass die Polizei das Produkt tatsächlich eingesetzt hat, erfuhr die Behörde jedoch erst auf Anfrage von netzpolitik.org und BR, wie der Landesdatenschutzbeauftragte Sebastian Schmidt auf Anfrage erklärt. Daraufhin habe die Behörde eine Prüfung eingeleitet. Zunächst müsse man herausfinden, welche Daten die Polizei tatsächlich genutzt habe und wofür – mehr Details zum konkreten Fall könne er deshalb nicht nennen. Grundsätzlich weist der Datenschützer jedoch auf drei mögliche Probleme bei kommerziellen Werbedaten hin:

Erstens könne die Polizei mit Standortdaten aus der Werbe-Industrie „ähnliche Erkenntnisse“ gewinnen wie mit einer Funkzellenabfrage – so nennt man es, wenn die Polizei Handys über Daten von Mobilfunkanbietern ortet. Diese Überwachungsmaßnahme muss aber ein*e Richter*in genehmigen. „Einen solchen Richtervorbehalt würde man zum Beispiel umgehen, wenn man kommerzielle Standortdaten nutzt, ohne dass man eine entsprechende Rechtsgrundlage dafür hat“, erklärt Schmidt.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Zweitens stecken in den Angeboten von Databrokern oftmals Daten von Millionen Geräten, also von sehr vielen Unbeteiligten. Daran seien noch mal andere Anforderungen geknüpft, als wenn es nur um Verdächtige gehe, erklärt der Datenschützer. „Wir prüfen selbstverständlich auch, ob Daten von unbeteiligten Dritten angekauft worden sind.“

Drittens ist bei kommerziell erworbenen Standortdaten nicht klar, ob sie rechtmäßig erhoben wurden. Die bisherigen Recherchen von BR und netzpolitik.org zeigen: Von der informierten Einwilligung, auf die sich viele App-Betreiber und Databroker mit Blick auf die europäische Datenschutzgrundverordnung (DSGVO) berufen, kann in der Regel keine Rede sein. Schmidt sagt: „Diese Daten dann für polizeiliche Ermittlungen zu verwenden, ist aus datenschutzrechtlicher Sicht nicht ganz unproblematisch.“

Die Prüfung könnte Schmidt zufolge etwa ein halbes Jahr lang dauern. Das heißt, Ergebnisse kommen nicht vor der Landtagswahl am 20. September, in der die in Teilen rechtsextreme AfD Umfragen zufolge stärkste Kraft werden könnte. Was würde eine potenzielle AfD-Regierung mit einem solchen Überwachungs-Instrument tun?

Polizei-Behörden sehen sich im Recht

Der Fall Mecklenburg-Vorpommern könnte für ganz Deutschland wichtig sein. Denn unsere Recherchen zeigen: Bundesweit gehen die Einschätzungen von Polizei- und Datenschutzbehörden zur Rechtmäßigkeit der Nutzung von Werbedaten auseinander.

Wir haben alle 16 Landesdatenschutzbehörden angefragt – keine nannte eine konkrete Rechtsgrundlage für den Einsatz kommerzieller Standortdaten durch die Polizei.

Offenbar bräuchte es jedoch eine solche Grundlage. Allgemeine Ermittlungsbefugnisse, sogenannte Generalklauseln, dürften nicht ausreichen. Das sagt etwa die Landesdatenschutzbeauftragte von Brandenburg auf Nachfrage von BR und netzpolitik.org. Generalklauseln “können unseres Erachtens nicht für die Erhebung und Verwendung kommerzieller Standortdaten herangezogen werden”.

Das LKA Brandenburg, das nach eigener Aussage auf Datenhändler zurückgreift, hat unsere Frage zur Rechtsgrundlage nicht beantwortet. Andere Polizeibehörden argumentieren jedoch mit Generalklauseln. Das LKA Mecklenburg-Vorpommern beruft sich etwa auf allgemeine Befugnisse in der Strafprozessordnung und dem Landespolizeigesetz. Auch die Landeskriminalämter von Hamburg, Nordrhein-Westfalen, Thüringen und Saarland halten den Einsatz kommerzieller Standortdaten für rechtlich möglich.

Diese neun LKAs schweigen

Während die Polizeibehörden in Brandenburg und Mecklenburg-Vorpommern einige Fragen offenlassen, sind die Behörden der meisten anderen Bundesländer noch weniger transparent.

Lediglich die Polizei in Bremen, Hessen, Rheinland-Pfalz, Sachsen-Anhalt und Schleswig-Holstein hat den Einsatz kommerzieller Werbedaten bei unseren jüngsten Presseanfragen klar verneint.

Neun weitere LKAs verwiesen auf Geheimschutzgründe und äußern sich nicht. „Um die Wirksamkeit der Strafverfolgung und der Gefahrenabwehr effektiv zu schützen und laufende Verfahren nicht zu gefährden, müssen diese Angaben vertraulich behandelt werden“, heißt es etwa aus Sachsen. Thüringen und Baden-Württemberg verweisen auf „polizeitaktische Gründe“.

Von „sensiblen Bereichen der Polizeiarbeit“, schreiben die Behörden in Niedersachsen und Hamburg. Auch Bayern, Berlin, Nordrhein-Westfalen und das Saarland verweigerten eine Auskunft.

Jurist: Praxis ist „rechtswidrig“

Darf die Polizei nun Werbedaten nutzen oder nicht? Der Jurist Mark Zöller ist Professor an der Ludwig-Maximilians-Universität München und forscht dort zu Innerer Sicherheit und Digitalisierung. Im Gespräch mit netzpolitik.org und BR sagt er zur Nutzung von Werbedaten durch die Polizei: „Nach dem jetzigen Stand der Dinge wäre das rechtswidrig.“

Eine Ermächtigungsgrundlage gebe es in keinem Polizeigesetz, Behörden könnten sich nicht auf bestehende Generalklauseln berufen. „Wer das im Moment macht, handelt ohne gesetzliche Grundlage.“

Zwar könne die Polizei im Einzelfall auch illegal erhobene Daten verwenden, wie der Jurist erklärt. Die Rechtsprechung folge dem Muster: Je schlimmer die Straftat, desto eher könne auch ein rechtswidrig erhobenes Beweismittel benutzt werden. Im Fall von Standortdaten und anderen Informationen aus der Werbeindustrie brauche es jedoch ausdrückliche gesetzliche Regelungen.

„Das Risiko halte ich für wirklich massiv, dass man da über die Hintertür Daten erhält, die man auf verfassungskonformen Weg als Staat eigentlich gar nicht zu sehen bekommen sollte“, sagt Zöller. Nach der Rechtsprechung des Bundesverfassungsgerichts müssten sich Menschen darauf verlassen können, dass ihre Daten nur für den Zweck verwendet werden, für den sie erhoben werden.

„Wir sehen das sehr häufig, dass Polizeibehörden neue technische Möglichkeiten erkennen und dann schon mal voranpreschen, weil die Verlockung groß ist, so etwas zu nutzen“, sagt Zöller mit Blick auf den Datenhandel. Auch ermittlungstaktisch könne man das nachvollziehen. Im Rechtsstaat funktioniere die Logik jedoch anders herum: „Erst regeln, dann loslegen.“

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Zöller sieht es kritisch, dass mehrere Polizeibehörden den Einsatz von Werbedaten weder bestätigen noch verneinen: „Das spricht dafür, dass das auch dort zumindest in Erwägung gezogen wird.“

Der Wiener Tracking-Forscher Wolfie Christl warnt vor den Folgen staatlicher Überwachung mit Werbedaten: „Sollten deutsche Polizeibehörden ADINT-Systeme einsetzen, wäre damit eine Art unkontrollierte Massenüberwachung möglich – auf Grundlage großer Mengen zugekaufter personenbezogener Verhaltensdaten über Millionen von Menschen in Deutschland.“

Er spricht vom „Missbrauch“ der Daten für Überwachung. „Es gibt über die gesamte Datenlieferkette hinweg keine Rechtsgrundlage für eine Weitergabe dieser Daten für Überwachungszwecke.“

Bundesbehörden mauern ebenfalls

Nicht nur in den Bundesländern verweigern Sicherheitsbehörden Transparenz, sondern auch auf Bundesebene. Nutzen etwa die Bundespolizei und Bundeskriminalamt Daten der Werbe-Industrie? Das wollte Ende 2025 die Bundestagsabgeordnete Donata Vogtschmidt (Die Linke) in einer Kleinen Anfrage wissen. Die Bundesregierung gab keine Auskunft.

Auch ein geringfügiges Risiko des Bekanntwerdens derart sensibler Informationen kann unter keinen Umständen hingenommen werden.

Nicht einmal in eingestufter Form, also unter Auflagen zur Geheimhaltung, wollte die Regierung das Parlament über eine mögliche Nutzung von Werbedaten durch Polizeibehörden informieren. Auch Auskünfte zur Nutzung durch Geheimdienste verweigerte sie auf vorherige Anfragen von netzpolitik.org und BR.

Fachleute halten es jedoch für wahrscheinlich, dass auch Bundesbehörden bei Databrokern einkaufen oder Dienste von ADINT-Anbietern nutzen. „Es gibt gute Gründe, davon auszugehen, dass dies längst geschieht“, schlussfolgern die Autoren einer Studie des Thinktanks Interface im Jahr 2024. Hinweise darauf gibt es unter anderem in der Begründung für die 2023 beschlossene Novelle des BND-Gesetzes.

Auch die Wissenschaftlichen Dienste des Deutschen Bundestages sehen Hinweise, „dass die Praxis kein Ausnahmephänomen darstellt, sondern zunehmend Teil des behördlichen Informationsmanagements wird“. Das dazu gehörige Gutachten entstand auf Anfrage von Linken-Politikerin Vogtschmidt.

Sollten Bundesbehörden tatsächlich Werbedaten kaufen, würde das laut Gutachten rechtlich auf tönernen Füßen stehen: Bundespolizei und Bundeskriminalamt hätten dafür keine Rechtsgrundlage, heißt es. Eine klare Rechtsgrundlage fehlt demnach sogar für Geheimdienste, die deutlich mehr Befugnisse zur Überwachung haben.

Politiker*innen warnen über Parteigrenzen hinweg

Hinter dem Geschäft mit Handy-Standortdaten steckt globale kommerzielle Massenüberwachung. Hierzu recherchieren netzpolitik.org, Bayerischer Rundfunk und internationale Recherche-Partner seit Februar 2024. Databroker bündeln Daten aus der Werbe-Industrie und verkaufen sie in riesigen Paketen, in der Regel rechtswidrig. Dabei geht es längst nicht mehr um personalisierte Werbung. Die Daten werden zur Handelsware – ein klarer Bruch mit der Zweckbindung, wie sie die DSGVO verlangt.

Allein anhand von Gratis-Kostproben verschiedener Anbieter konnte das Recherche-Team inzwischen mehr als 13 Milliarden Handy-Standorte von Millionen Betroffenen weltweit sammeln und auswerten.

In zahlreichen Veröffentlichungen haben die Databroker Files gezeigt: In den Daten stecken teils genaueste Bewegungsprofile. Sie verraten Wohnadressen und Urlaubsziele, aber auch Privates wie Besuche in Kliniken, Bordellen oder religiösen Einrichtungen. Ausspionieren lassen sich selbst hochrangige Beamt*innen der Bundesregierung und der EU-Kommission oder Menschen mit Zugang zu Militärstützpunkten und Geheimdiensten.

Sicherheitsbehörden müssen die milliardenfachen Standortdaten nicht selbst auswerten. Dafür bieten spezialisierte Firmen Software an. Zum Angebot gehört eine interaktive, grafische Nutzungsoberfläche, ähnlich wie ein Online-Kartendienst. Statt nach Restaurants können Beamt*innen damit etwa nach Handy-Ortungen in bestimmten Gebieten suchen sowie nach den Bewegungsprofilen bestimmter Geräte.

Für den Zugriff auf solche Software verlangen ADINT-Firmen eine Gebühr. Zur Branche gehören etwa die US-amerikanische Firma Penlink, das israelische Unternehmen Rayzone oder das italienische RCS Labs. Zu den öffentlich bekannten Kunden zählen die US-amerikanische Abschiebe-Miliz ICE und die ungarische Regierung, wie kürzlich das Citizen Lab der Universität Torotono mit dem Medium VSquare aufgedeckt hat.

Parteiübergreifend haben Politiker*innen in Deutschland und in der EU den unkontrollierten Handel mit Standortdaten aus der Werbeindustrie als Gefahr für die innere und äußere Sicherheit bezeichnet. Mit Blick auf erhöhte Gefahr von Spionage ist die Sorge groß, dass ausländische Geheimdienste solche Daten nutzen.

Korrektur, 2. Juni, 12:00 Uhr: Aus den Antworten des LKA Brandenburg geht nicht klar hervor, ob die von Datenhändlern beschafften kommerziellen Daten aus der Werbe-Industrie stammen oder möglicherweise aus Quellen außerhalb der Werbe-Industrie. Auch auf direkte Nachfrage hat die Behörde das nicht offengelegt. Das war etwa im Teaser und in der Info-Grafik nicht sauber formuliert. Wir haben das korrigiert.

netzpolitik.org und Bayerischer Rundfunk recherchieren weiter zur Nutzung von Werbedaten durch Polizeibehörden. Für Hinweise sind die Autoren Ingo Dachwitz und Sebastian Meineck dankbar.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die Beweise für positive Klimaauswirkungen durch sogenannte „KI“ sind schwach, während die Klimaschäden klar belegt sind. Ein Bericht von AlgorithmWatch zeigt, dass die Klima-Versprechen nicht eingelöst werden können. Um das zu verschleiern, vermischen die Unternehmen verschiedene KI-Technologien – und klammern die energiehungrige generative KI dabei aus.

Der Ausbau von KI-Rechenzentren führt zu einer steigenden Nachfrage nach fossilen Brennstoffen, denn der Energiehunger von KI-Technologien ist offensichtlich. Die nachweislich negativen Auswirkungen auf das Klima werden von den Technologieunternehmen jedoch heruntergespielt, während sie gleichzeitig in Aussicht stellen, KI könne in der Zukunft helfen, die Probleme des Klimawandels zu bewältigen.

Die Behauptungen von Big-Tech beruhen dabei nicht auf glaubwürdigen und belegbaren Daten, sondern auf der Selbstausstellung eines „Blanko-Schecks“, um „die Umwelt unter Verweis auf leere Heilsversprechen weiter zu verschmutzen“. Zu diesem Ergebnis kommt der neue Bericht von AlgorithmWatch: „Der KI-Klimaschwindel: Hinter den Kulissen des Big-Tech-Greenwashings“. Während die negativen Auswirkungen nachweisbar seien sowie immer weiter zunehmen würden, basierten die Lösungsversprechen hauptsächlich auf Wunschdenken mit geringer Faktenbasis.

Der Bericht untersucht systematisch die Stichhaltigkeit der Behauptung eines angeblichen „Netto-Klimanutzens“ durch KI. Aus insgesamt acht Quellen wurden dafür 154 KI-Klimaversprechen extrahiert. Das Ergebnis: 150 Versprechen (97 Prozent) bezogen sich entweder auf die „herkömmliche“ KI, also insbesondere auf Vorhersagemodelle und Computer-Vision, oder generative KI mit einem nur sehr eng begrenzten Anwendungsbereich. Nur vier Behauptungen (drei Prozent) bezogen sich tatsächlich auf klar definierbare generative KI-Anwendungen für Verbraucher:innen (wie Chatbots), die mit großen öffentlich zugänglichen Datensätzen trainiert wurden. Die Klimaauswirkungen generativer KI werden durch verallgemeinerte „KI-Nachhaltigkeitsbehauptungen“ also gezielt verschleiert, indem grundsätzlich verschiedene Technologien gleichgesetzt werden.

„ ‚KI’ ist ein sehr neuer Begriff, auch wenn einige der Technologien schon sehr alt sind“, sagt der Hauptautor des Berichts, Energie- und Klimaanalyst Ketan Joshi, gegenüber netzpolitik.org. „Daher nutzen sie diese Unvertrautheit aus. Indem sie diese beiden Dinge miteinander vermischen und den Wandel als unvermeidlich darstellen, entziehen sie sich jeglicher Verantwortung, auf die schlechten, verschwenderischen und schädlichen Dinge zu verzichten.“

KI ist nicht gleich KI

Der für das Jahr 2030 prognostizierte Energieverbrauch generativer KI-Anwendungen liegt dabei um das Dreizehnfache höher als der Energieverbrauch herkömmlicher KI. Dennoch werde unterschlagen, dass die Klimaschäden durch KI-Nutzung überwiegend durch eben diese generativen KI-Anwendungen entstehen. Die Analyse fand so kein einziges Beispiel einer generativen Consumer-KI, die nachweislich zu einer Emissionsreduktion geführt hätte.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

„Wenn es Nachhaltigkeitsvorteile durch künstliche Intelligenz gibt, dann durch Anwendungen traditioneller KI mit wenig Ressourcenverbrauch. Die großen sprach- und bildgenerierenden Modelle wie ChatGPT […] verbrauchen Unmengen an Strom und Wasser, verursachen CO₂-Emissionen in der Höhe ganzer Länder, bringen aber keinerlei positiven Nutzen für die Umwelt“, sagt Senior Policy Manager bei AlgorithmWatch, Julian Bothe, gegenüber netzpolitik.org.

Ferner stützen sich laut der Analyse des Reports nur 26 Prozent der 154 untersuchten KI-Klimaversprechen auf tatsächlich wissenschaftliche Studien. 36 Prozent führten keinerlei Belege an, während der Rest überwiegend auf die Unternehmensberichte und Unternehmenswebseiten verwies. Hinzu kämen Verweise auf Medien, sonstige Institutionen oder unveröffentlichte Studien.

Viel Behauptung, kaum Beleg

Ein besonders prägnantes Beispiel sei Google: Der Konzern wirbt seit Jahren damit, KI könne bis 2030 fünf bis zehn Prozent der weltweiten Treibhausgasemissionen einsparen. Dies entspräche dem gesamten Jahresausstoß der Europäischen Union. Die Quelle dieser Statistik hält allerdings keiner Überprüfung stand: Diese ist nämlich der Blogbeitrag eines Beratungsunternehmens aus dem Jahr 2021, das diese Einschätzung offenbar aus der eigenen „Kundenerfahrung“ entnommen hatte. Dennoch tauchte die Behauptung noch im April 2025 in einer Policy-Roadmap von Google auf, die auf die EU zielte – und zwar unter dem Verweis auf „Studien“.

Einige der Zahlen stammen jedoch nicht unmittelbar aus der Unternehmens-PR und tragen ein wissenschaftliches Etikett. Eine Analyse des Ökonomen Nicholas Stern, veröffentlicht in einem Nature-Fachjournal, kommt zu dem Schluss, KI werde die weltweiten Emissionen bis 2035 um 36 Prozent senken. Amy Luers, Head of Sustainability Science and Innovation bei Microsoft, beziffert das Einsparpotenzial in einem Kommentar in Nature auf 1,4 Gigatonnen jährlich. Auch der einflussreiche IEA-Bericht „Energy and AI“ vom April 2025, dessen Entwurf unter anderem von Beschäftigten von Amazon, Google, Nvidia, Meta und Microsoft begutachtet wurde, kommt zu dem Ergebnis, dass KI unter bestimmten Bedingungen Netto-Emissionen einsparen könnte. Der AlgorithmWatch-Bericht hält solche Rechnungen jedoch für fragwürdig, weil sie auf schwach begründeten Beispielen aufbauen. „Es hat mich überrascht, solche Behauptungen in Nature zu sehen“, sagt Joshi. Viele wissenschaftliche Publikationen seien beim KI-Thema enthusiastisch und „womöglich nicht im Einklang mit dem, was wir über die Umweltschäden wissen“.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Ein weiteres Beispiel für irreführende Behauptungen sei auch die der Internationalen Energieagentur, dass das Kreuzfahrtunternehmen Carnival Cruise Lines dank KI seinen Treibstoffverbrauch erheblich gesenkt habe, so Joshi gegenüber netzpolitik.org. „Es scheint wahrscheinlich, dass der Verweis auf der Website größtenteils mithilfe von KI generiert wurde – oder dass es sich zumindest um eine schwache Quelle handelt, die keinen Bezug zu den tatsächlichen Berichten des Unternehmens aufweist.“ Dies verdeutliche laut Joshi, wie das Potenzial von KI nicht nur überbewertet wird, sondern auch, wie KI selbst das Informationsumfeld zerstöre.

Neue Form des Greenwashings

Rechenzentren verbrauchten 2024 rund 1,5 Prozent des weltweiten Stroms, bis 2030 erwartet die IEA eine Verdopplung. Die großen Tech-Konzerne verfehlen ihre eigenen Klimaziele und an den Standorten von Meta, OpenAI und xAI entstehen neue Gaskraftwerke. Der Bericht sieht so eine neue Greenwashing-Strategie. Emissionsintensive Industrien versuchen seit jeher ihre angerichteten Schäden kosmetisch „auszugleichen“, beispielsweise mit betrugsanfälligen Klimazertifikaten. Neu sei hingegen, dass unterschiedliche Technologien unter dem Überbegriff „KI“ zusammengefasst werden, um der Verantwortung für den Ausbau energiehungriger generativer KI zu entgehen.

Tatsächlich gibt es laut Bericht keinerlei glaubwürdige Grundlage für die Aussage, die klimafreundlichen Auswirkungen von Künstlicher Intelligenz würden die schädlichen Folgen der Technologie wieder ausgleichen können. Der Bericht behauptet gleichwohl nicht, dass KI keinerlei Klimanutzen haben könne. Unbelegt sei jedoch das Narrativ, KI könne Schäden im Gigatonnen-Bereich ausgleichen. Statt mit vagen Begriffen und schwachen Belegen die Klimaschäden zu verschleiern, läge die Verantwortung, in echte Nachhaltigkeit zu investieren, weiterhin bei den Big-Tech-Konzernen.

„Wenn es Google, Microsoft und Co. ernst wäre mit ihrer Sorge um die Umwelt, würden sie die Auswirkungen ihrer KI-Technologien offenlegen und auch die tatsächlichen Verbräuche der dafür genutzten Rechenzentren transparent veröffentlichen“, findet Bothe. „Tatsächlich passiert das Gegenteil: Die großen Tech-Unternehmen tun alles dafür, um sich sogar der gesetzlich geregelten Veröffentlichungspflichten zu entledigen – und die Regierungen auf EU- und Bundesebene knicken vor den Forderungen der Tech-Giganten ein.“

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die Bildungsministerkonferenz findet Medienkompetenz in Sachen Social Media und Digitalisierung zwar wichtig, doch konkrete Maßnahmen ergreifen will sie nicht. Laut einem Medienbericht führt das zu Verantwortungsdiffusion.

Die Bildungsministerkonferenz wird keine wirklichen und zählbaren Maßnahmen ergreifen, um die Medienkompetenz von Kindern in Sachen Social Media in der Schule zu stärken. Das geht aus einem Bericht des Tagesspiegel Background (€) hervor, dem der Entwurf der „Erklärung der Bildungsministerkonferenz“ vorliegt. Demnach ist eine konsequente Ausweitung der Medienbildung an Schulen darin kein Schwerpunkt.

Laut dem Bericht sehen die Kultusminister vor allem die Eltern für die Medienkompetenz ihrer Kinder verantwortlich. „Die verfassungsrechtlich verankerten Erziehungspflichten und ‑rechte der Eltern stehen in diesem Feld im Vordergrund“, zitiert Background aus dem Bericht. Als Argument führen die Minister:innen an, dass die problematische Mediennutzung ja „überwiegend außerhalb der Schule“ stattfinde.

Zwar würden dem Medienbericht zufolge die Minister:innen postulieren, dass Schulen in Sachen Medienkompetenz einen „entschlossenen Beitrag“ leisten müssten. Gleichwohl gibt es in dem Papier nur eine Stelle, an der die Minister:innen festhalten, dass die Medienbildung an Schulen derzeit nicht ausreiche. Fakt ist laut dem Tagesspiegel, dass es nur in fünf der 16 Bundesländer überhaupt ein Fach Medienbildung gibt und auch der flächendeckende Ausbau von Informatik als Pflichtfach demnach noch Jahre dauern wird.

In der Erklärung der Kultusminister heißt es weiter, dass „schulische Bildungs- und Erziehungsangebote“ weiter ausgebaut werden sollen, doch konkrete Maßnahmen oder Stundenzahlen nennt der Text nicht. Statt konkreter Pläne stellt das Papier eher Projekte hervor, bei denen sich Schüler:innen gegenseitig Medienkompetenz beibringen sollen oder bei denen Initiativen von außen, beispielsweise aus dem Journalismus, in die Schule hineinwirken sollen. Tagesspiegel Background spricht hier deswegen von Verantwortungsdiffusion.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

In seiner Enzyklika erklärt Papst Leo XIV. den Umgang mit KI zur „sozialen Frage“ unserer Zeit. Und auch bei anderen Themen knüpft er an aktuelle netzpolitische Debatten an. Gleichzeitig folgt der Vatikan den eigenen Maximen nicht immer konsequent.

„Nichts ist in der Welt der KI immateriell oder magisch“, stellt Papst Leo XIV. in seiner Enzyklika „Magnifica humanitas“ fest, die er am Pfingstmontag veröffentlichte und die medial einige Wellen geschlagen hat.

Wenn der Papst über „Künstliche Intelligenz“ schreibt, dann will er seine Reflexionen nicht auf das Endprodukt reduziert wissen. Stattdessen lenkt er den Blick auf die gesamte Lieferkette, die zu einer scheinbar mühelos auf dem Bildschirm aufscheinenden Antwort führt. Er spricht von einem „ausgedehnten Netzwerk aus natürlichen Ressourcen, Energieinfrastruktur und vor allem Menschen“.

Und der Papst belässt es nicht bei diesem einen Thema. Vielmehr spannt er mit in knapp 250 Abschnitten einen weiten Bogen über zahlreiche netzpolitische Themen: von Fragen nach digitalem Kolonialismus, Überwachung und algorithmischer Diskriminierung über die Regulierung von multinationalen Digitalkonzernen und der digitalen Allmende bis hin zur brandaktuellen Frage nach Altersgrenzen für Social-Media-Dienste.

Anschlussfähig an progressive Netzpolitik

Eine Enzyklika ist primär ein theologisches Dokument. Der Ansatz ist daher auch ein religiös begründeter.

Die Würde des Menschen gründet nach katholischem Verständnis in der Gottesebenbildlichkeit und ist zentral für die Organisation von Gemeinwesen. Eine gerechte Gesellschaft muss so organisiert sein, dass sie die Würde des Menschen schützt und fördert. Aus dem kirchlichen Verständnis des Menschen entwickelt die katholische Soziallehre Sozialprinzipien, die ethische Leitplanken für gesellschaftliche und politische Institutionen bilden: Personalität, Solidarität, Subsidiarität, Gemeinwohl und Gerechtigkeit sowie integrale Entwicklung, was säkular formuliert ungefähr Nachhaltigkeit bedeutet.

Das ist der Instrumentenkasten, mit dem der Papst aus der Tradition der katholischen Soziallehre argumentiert. Vor allem die Prinzipien der Subsidiarität, der Gerechtigkeit und der Nachhaltigkeit macht er in seiner Enzyklika stark. Damit zeigt er sich nicht nur erstaunlich anschlussfähig an digitalpolitische Diskurse, sondern auch an progressive Netzpolitik.

Drei in der Enzyklika behandelte Bereiche zeigen das besonders deutlich: die kritische Haltung zu Datenkolonialismus, die Problematisierung des Überwachungskapitalismus und ein Plädoyer für die digitale Allmende.

Das „neue Gesicht“ des Kolonialismus

Für den Papst zeigt der Kolonialismus heute ein „neues Gesicht“: „Er beherrscht nicht mehr nur Körper, sondern eignet sich Daten an und verwandelt das persönliche Leben in verwertbare Informationen.“

Das trifft auf den Umgang mit Menschen im globalen Norden zu, umso mehr aber auch auf den globalen Süden. In Regionen „mit geringerer geopolitischer Bedeutung und größerer struktureller Anfälligkeit“ sieht der Papst eine neue Logik der Ausbeutung, die sich nicht nur physischer Rohstoffe bemächtigt, sondern sich auch Gesundheitsdaten, epidemiologische Profile, genetische Karten und demografische Daten einverleibt.

Diese Informationen bezeichnet Leo als „Seltene Erden der Macht“, deren systematische Verknüpfung, Auswertung und Ausbeutung im Kern die Gefahr mit sich bringt, „auszuwählen, wer und was zählt“. Gesundheitsdaten beschreibt er als „strukturellen Hebel für die Zukunft“.

Der päpstliche Lösungsansatz greift den Gedanken der informationellen Selbstbestimmung auf: Es gelte, den Menschen die Daten zurückzugeben, die sie beschreiben, und sie in die Lage zu versetzen, „zu entscheiden, wie diese genutzt werden, von wem und für wen“.

Konkret fordert der Papst Transparenz für die Lieferketten der Digitalwirtschaft, klare Kriterien für eine präventive ethische Überprüfung und Standards für Arbeitnehmer*innen-Schutz.

„Andernfalls wird das digitale Zeitalter nicht postkolonial sein, sondern in einer anderen Form kolonial“, so der Papst.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Wenn der Papst wie das Bundesverfassungsgericht klingt

Papst Leo XIV. will außerdem die „Freiheit vor Abhängigkeit und Kommerzialisierung schützen“. Er problematisiert, dass Plattformen darauf ausgelegt seien, „die Zeit und Aufmerksamkeit der Nutzer zu binden, indem ihre Schwachstellen ausgenutzt und ihre innere Freiheit geschwächt werden“. Derartige Geschäftsmodelle fasst er als Verzweckung des Menschen auf.

Für eine Regulierung und Begleitung dieser Phänomene schlägt der Papst mehrere Ansätze vor: „Erziehung zu digitaler Zurückhaltung, Schutz von Minderjährigen und Bekämpfung von Modellen, die aus der Verletzlichkeit anderer Nutzen ziehen“.

In der Überwachung und Kommerzialisierung durch Profilbildung sieht der Papst ein weiteres Problem, das mit sozialer Kontrolle einhergeht. „Wenn jede Handlung – Bewegungen, Käufe, Beziehungen, Vorlieben – Spuren hinterlässt, dann entsteht eine neue Macht: jene, Profile zu erstellen, Vorhersagen zu treffen und Verhalten zu beeinflussen, oft ohne dass sich die Menschen dessen voll bewusst sind.“

Das gefährde die Freiheit und diskriminiere vor allem die Schwächsten. Dabei komme es nicht nur auf tatsächliche repressive Maßnahmen an: „Was verstärkt oder unsichtbar gemacht wird, was belohnt oder bestraft wird, prägt letztlich Meinungen und Entscheidungen und führt zu Konformität und Selbstzensur.“

Hier klingt der Papst fast wie das Bundesverfassungsgericht: „Wer unsicher ist, ob abweichende Verhaltensweisen jederzeit notiert und als Information dauerhaft gespeichert, verwendet oder weitergegeben werden, wird versuchen, nicht durch solche Verhaltensweisen aufzufallen“, heißt es im Volkszählungsurteil aus dem Jahr 1983.

Daten als „gemeinsames oder kollektives Gut“

Bisher war der Vatikan eher durch eine restriktive Haltung bei Immaterialgüterrechten bekannt, zumindest, wenn es um Urheberrecht geht: Das Urheberrecht des Staats der Vatikanstadt ist eher beschränkend. Amtliche vatikanische Texte sind nicht gemeinfrei, bei der Digitalisierung von Archiven und Kunstschätzen wird nicht auf Commons und Open Data gesetzt.

Urheberrechte spricht Papst Leo in der Enzyklika zwar nicht direkt an. In Bezug auf Immaterialgüterrechte zeigt er sich aber deutlich Allmende-orientiert. Er greift dazu das theologische Verständnis der Gemeinwohlpflichtigkeit des Eigentums auf und macht es für Immaterialgüter fruchtbar.

„Daten sind das Ergebnis der Beiträge vieler und dürfen nicht an einige Wenige verkauft oder ihnen überlassen werden“, heißt es an einer Stelle, wo sich der Papst dafür ausspricht, Daten teilhabeorientiert als „gemeinsames oder kollektives Gut zu verwalten“.

An anderer Stelle bezeichnet er „Patente, Algorithmen, digitale Plattformen, technologische Infrastrukturen, Daten“ als Güter, die für alle bestimmt sind. „In einem Kontext, in dem der Reichtum der Nationen immer mehr von Wissen und Technologien abhängt, entsteht ein neues Ungleichgewicht, wenn diese Güter ohne angemessene Teilhabe und Zugangsmöglichkeiten in den Händen weniger konzentriert bleiben“, so Leo weiter.

Netzpolitische Kontinuitäten

Dass der amtierende Papst und mit ihm die katholische Kirche sich in dieser Weise netzpolitisch positionieren, ist in weiten Teilen keine Überraschung. Seit mindestens rund 25 Jahren betreibt der Vatikan Netzpolitik.

Die ersten Texte zu Ethik und Kirche im Internet erschienen bereits 2002. Zeittypisch wurde darin vor allem die Chancen für Kommunikation und Vernetzung betont, verbunden mit einem Appell zu gemeinwohlorientierter Entwicklung. Papst Johannes Paul II. (1978–2005) legte großen Wert auf die Nutzung neuer Medien, unter seinem Nachfolger Benedikt XVI. (2005–2013) waren die Botschaften zum katholischen „Welttag der Sozialen Kommunikationsmittel“ durch differenzierte Stellungnahmen zu digitalen Kommunikationsdynamiken geprägt.

In der späteren Phase des Pontifikats von Franziskus (2013–2025) trat KI in den Fokus. Im Jahr 2020 entwickelte die Päpstliche Akademie für das Leben mit dem „Rome Call for AI Ethics“ einen aus christlichen Werten gespeisten, aber durch Kooperationspartner aus der Wirtschaft und anderer Religionen anschlussfähigen KI-Kodex.

Im vergangenen Jahr veröffentlichten das Glaubens- und das Kulturdikasterium, also die römischen Behörden, die für theologische Grundsatzfragen und den Dialog mit der Kultur zuständig sind, die Erklärung „Antiqua et nova“ („Altes und Neues“) über das Verhältnis von Künstlicher Intelligenz und menschlicher Intelligenz, die ersten systematischen Ausführungen zum Umgang mit KI. In diesem Dokument hat die katholische Kirche auch erstmals Datenschutz theologisch hergeleitet und fundiert begründet.

Anschlussfähig an eine säkulare Öffentlichkeit

Mit seiner Enzyklika baut Leo XIV. auf dieser Vorarbeit auf und schreibt die Linien seiner Vorgänger und der Äußerungen aus den Vatikanbehörden fort.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Dass dies nun erstmals in der Form einer Enzyklika geschieht, ist das eigentlich Bedeutende – nicht nur, weil diese Form auch in der säkularen Öffentlichkeit so anschlussfähig ist, dass die Veröffentlichung tagelang weltweit in den Medien präsent war.

Eine Enzyklika ist die feierlichste Form der Ausübung des „ordentlichen Lehramts“ des Papstes. Unfehlbar ist sie nach katholischem Verständnis indes nicht. Aber wer katholisch ist, hat – so will es das Kirchenrecht – das anzuerkennen, was Päpste so vorlegen.

Seit geraumer Zeit wenden sich Päpste mit ihren Enzykliken nicht mehr nur an Katholik*innen, sondern an „alle Menschen guten Willens“ – entsprechend anschlussfähig an globale Diskurse müssen die Lehrschreiben sein. Das gilt insbesondere dann, wenn es wie in diesem Fall um soziale Fragen geht.

Der Umgang mit KI als die „soziale Frage“ unserer Zeit

Mit seiner Enzyklika stellt sich Leo XIV. in die Tradition seiner Vorgänger. Sein Namenspate Leo XIII. (1878–1903) hatte sich 1891 als erster Papst mit einer Sozialenzyklika zu zentralen Fragen des gesellschaftlichen und sozialen Zusammenlebens geäußert. Für Leo XIII. bestand die soziale Frage seiner Zeit in den Auswirkungen der Industrialisierung auf die Welt der Arbeit. Sein Lehrschreiben „Rerum novarum“ kam für die Industrielle Revolution der Mitte des 19. Jahrhunderts allerdings reichlich spät.

Leo XIV. hat den Umgang mit KI in einer seiner ersten Ansprachen als Papst als „soziale Frage“ unserer Zeit bezeichnet. Anders als Leo XIII. schreibt er zu einem Zeitpunkt, in dem die von ihm behandelte gesellschaftliche Umwälzung noch so weit am Anfang steht, dass gesellschaftliche Auswirkungen offen sind und politische Regulierungsinstrumente erst entwickelt werden.

Sozialenzykliken haben das Potenzial, den gesellschaftlichen Kurs zu beeinflussen, vor allem aber, Schwerpunkte in der Kirche zu setzen. Das jüngste Beispiel dafür ist die Umweltenzyklika „Laudato si“, in der sich Papst Franziskus 2015 umfangreich mit Nachhaltigkeit befasst und das Klima und die Umwelt als gemeinschaftliches Gut bezeichnet hat. Die Enzyklika hat Nachhaltigkeit zu einem kirchlichen Kernthema gemacht. Weltweit befassen sich Kirchengemeinden und kirchliche Verbände seither intensiv mit der praktischen Umsetzung.

Positive Resonanz aus Brüssel

Obwohl die Enzyklika von Papst Leo XIV. größtenteils nur den Rahmen vorgibt, kann sie also Wirkungen entfalten. Rückenwind erhält etwa das Projekt der Europäischen Union, Datenkolonialismus und Überwachungskapitalismus durch Regulierung zu gestalten. „Wir können der Vision des Heiligen Vaters Papst Leo XIV. und der Notwendigkeit eines soliden Rechtsrahmens für KI nur zustimmen“, äußerte sich ein Sprecher der Kommission dann auch gegenüber der Katholischen Nachrichten-Agentur.

Mit seiner Enzyklika scheint der Papst somit einen Nerv getroffen zu haben. Die Bewertungen fallen größtenteils positiv aus – auch, weil sich Leo XIV., der vor seiner Wahl zum Papst selbst soziale Medien und insbesondere „X“ nutzte, die alte Twitter-Kulturtechnik des Diss per Nonmention beherrscht. Mal weniger subtil, wenn er darüber klagt, dass sich in der Weltpolitik „religiöser Extremismus und identitätsbasierter Fanatismus […] mit irrationaler Wirtschaftspolitik“ verbünden, mal etwas subtiler, wenn er Herr-der-Ringe-Fans wie Elon Musk und dem Palantir-Gründer Peter Thiel mit einem Zitat von Gandalf Nachhaltigkeit und Bescheidenheit erklärt.

Auch der Vatikan ist mitunter nicht konsequent

Es bleiben aber auch offene Fragen. Denn so klar die ethischen Leitplanken für KI und die Digitalwirtschaft auch sind, so unverständlich ist die Beteiligung von Anthropic-Mitgründer Chris Olah bei der Pressekonferenz zur Vorstellung der Enzyklika.

Zwischen dem Vatikan und Anthropic, die sich selbst eines ethischeren Anspruchs für ihre Produkte rühmen, gibt es seit längerer Zeit einen Austausch. Das Unternehmen mag damit weniger problematisch als andere KI-Hersteller sein. Die in der Enzyklika benannten umfassenden Probleme der Nachhaltigkeit, des Energieverbrauchs und der Umwälzung des Arbeitsmarkts gelten aber pauschal für die Technologie – und damit auch für Anthropic.

Ein Ausreißer ist das allerdings nicht: Das Unternehmen reiht sich damit ein in die Riege von Tech-Konzernen, die mit dem Vatikan in Sachen Digital-Ethik kooperieren – der „Rome Call“ wurde etwa von Microsoft und IBM unterzeichnet. Und in der Vergangenheit gab es ebenfalls klare Aussagen zur Rolle von Krypo-Währungen im Menschenhandel. Zugleich kooperiert die Vatikan-Bibliothek mit einem Blockchain- und NFT-Start-up. Das zeigt: Auch im Vatikan selbst ist die konsequente Umsetzung ethischer Erkenntnisse nicht immer einfach.

Felix Neumann ist Journalist und schreibt über die Schnittpunkte von Kirche, Recht und Digitalität als Redakteur bei katholisch.de und Herausgeber von „Artikel91.eu – Datenschutz in Kirchen und Religionsgemeinschaften“.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die 22. Kalenderwoche geht zu Ende. Wir haben 8 neue Texte mit insgesamt 58.965 Zeichen veröffentlicht. Willkommen zum netzpolitischen Wochenrückblick.

Liebe Leser*innen,

mit unseren Veröffentlichungen zu den Databroker Files haben wir einiges angestoßen, und der Stein rollt weiter. Es geht um den meist illegalen Handel mit Handy-Standortdaten der Werbe-Industrie.

In den USA haben Senator*innen und Kongressabgeordnete jüngst das Pentagon befragt, wie dieser Datenhandel US-Soldat*innen gefährdet. Das klingt weit weg – ist aber eine direkte Folge unserer Recherchen. Im November 2024 hatten wir gemeinsam mit dem US-Magazin Wired veröffentlicht, wie Datenhändler NATO und US-Militär bloßstellen.

Anhand von Handy-Ortungen in Deutschland konnten wir genaue Bewegungsprofile von Militär-Angehörigen nachvollziehen. Etwa in Grafenwöhr, dem größten Übungsplatz für das US-Militär in Europa, oder in der Ramstein Air Base, dem Hauptquartier der US Air Force für Europa und Afrika. Die Bewegungsprofile, die wir sahen, führten von Baracken zu Privatadressen, zu Supermärkten und teils bis zu Bordellen.

Nun, da wir eure Aufmerksamkeit haben …

Auf diese Recherche haben sich die US-Senator*innen und Kongressabgeordneten in ihren Fragen direkt bezogen. Und aus der Antwort des US-Kriegsministeriums geht klar hervor: Kommerziell verfügbare Handy-Standortdaten können US-Soldat*innen zur Zielscheibe machen.

Entsprechende Warnungen habe das Zentralkommando bereits an Truppen verschickt. Es ist zuständig für den Nahen Osten, Zentralasien und Teile Südasiens, also auch für jene Soldat*innen, die gerade Angriffe gegen den Iran führen. Zuvor habe man „mehrere Berichte über Bedrohungen erhalten, wonach Gegner kommerzielle Standortdaten ausnutzen, um US-Personal im Einsatzgebiet ins Visier zu nehmen oder zu überwachen“.

Zuerst berichtet hat das die Agentur Reuters, mit Verweis auf die Vorrecherchen von zwei deutschen „news outlets“ – gemeint sind der Bayerische Rundfunk und wir.

Ich erinnere mich noch gut, wie wir 2024 abgewogen hatten, ob wir noch einen extra Artikel zu US-Soldat*innen bringen sollen. Immerhin hatten wir schon berichtet, wie der Datenhandel alle gefährdet – und nationale Sicherheit ist kein Kernthema von netzpolitik.org. Aber wir hatten die Ahnung: Die Perspektive könnte ein Türöffner sein, um Menschen zu erreichen, die sich sonst nicht für Datenschutz und Privatsphäre stark machen, die Massenüberwachung ausweiten statt eindämmen.

Die Reaktionen aus dem Pentagon zeigen: Das hat geklappt. Reuters schreibt: „Gesetzgeber fordern das Pentagon zum Handeln auf und bezeichnen die Adtech-Branche als Bedrohung für die nationale Sicherheit“. Bingo. Möglich ist das jedoch nur, weil unsere Recherchen anschauliche Beispiele liefern, hier etwa für den demokratischen Senator Ron Wyden und sein Team, die seit Jahren mit viel Mühe zu diesem Thema arbeiten.

US-Militär kämpft gegen Werbetracking

Laut Pentagon arbeite man immer noch daran, das Werbetracking auf den Dienstgeräten der Soldat*innen wirksam abzuschalten. Das sei man gerade am Testen…

In meinen Augen zeigt das: Der oftmals zitierte Kontrollverlust rund um Tracking und Datenhandel trifft nicht nur Verbraucher*innen. Selbst eine mächtige Institution wie das US-Militär ringt damit, die gefährliche Spur der angeblich nur zu Werbezwecken erhobenen Daten abzuschütteln. Wie absurd ist das bitte?

Und damit zurück zum Datenschutz: Seit Jahren fordern Fachleute ein Verbot von Tracking und Profilbildung zu Werbezwecken. Das würde allen eine Menge Ärger ersparen. Mich würde es freuen, wenn der Stein, den wir da ins Rollen gebracht haben, eines Tages den unkontrollierten Datenhandel umkegelt. Davon sind wir aber noch sehr weit entfernt. Stattdessen setzen Regierungen, unter anderem in den USA, die Werbedaten selbst zur Überwachung ein.

Databroker Files in Österreich und Spanien

Auch in internationalen Medien ziehen die Databroker Files derweil weiter Kreise. Diese Woche hat der öffentlich-rechtliche Rundfunk in Österreich (ORF) das Thema fürs ZIB Magazin aufbereitet.

Für den spanischen TV-Sender Radiotelevisión Española RTVE wiederum hat mein Kollege Ingo Dachwitz das Geschäft mit unseren Daten erklärt. Die 74-minütige Doku von und mit dem Journalisten Carles Tamayo ist diese Woche erschienen.

Und nächste Woche legen wir nach, wieder zusammen mit unseren Kolleg*innen des Bayerischen Rundfunks. Eine neue Veröffentlichung, eine neue Dimension. Lasst euch überraschen.

Schönes Wochenende und bis die Tage

Sebastian

a German news outlet

Breakpoint: Das Internet verrottet

Tote Links, gelöschte Webpages und geänderte URLs machen das Internet zu einem Ort der Sackgassen. Wie Informationen im Netz verschwinden, erinnert an einen der berühmtesten Bibliotheksbrände der Geschichte. Doch allzu oft sind es nicht Katastrophen, die Wissen vernichten, sondern Desinteresse. Von Carla Siepmann –

Artikel lesen

Für 250 Millionen Euro: Bund schafft neue Abhängigkeiten von IT-Konzernen

Für eine dreistellige Millionensumme sollen SAP und Telekom eine „KI-Cloud“ für die öffentliche Verwaltung bauen. Digitalminister Karsten Wildberger nennt das souverän. Unabhängig wird Deutschlands Verwaltung damit nicht, warnen Opposition und Fachleute. Von Esther Menhard –

Artikel lesen

Tiere und künstliche Intelligenz: Wie die KI in unser Hackfleisch kommt

Künstliche Intelligenz ist inzwischen in der Massentierhaltung angekommen. Doch können Verhaltensscanner im Stall wirklich das Tierwohl verbessern? Und welches Rezept spuckt ein KI‑Chatbot aus, wenn man ihn nach Spaghetti Bolognese fragt? Mirjam Walser warnt im Interview: Die Folgen von KI für Tiere sind enorm. Von Timur Vorkul –

Artikel lesen

Strafanzeige: Journalist wehrt sich gegen Staatstrojaner-Angriff

Ein deutsch-vietnamesischer Journalist wurde mit dem Staatstrojaner Predator angegriffen. Jetzt stellt er Strafanzeige, gemeinsam mit der GFF. Die Staatsanwaltschaft soll die Täter ermitteln und die Grundrechte schützen. Besonders pikant: Nicht nur das Opfer kommt aus Deutschland, sondern auch Anbieter und Kunden. Von Constanze, Andre Meister –

Artikel lesen

Unsichere Billigimporte: EU-Kommission überzieht Temu mit einer satten Strafe

Der chinesische Online-Händler Temu schlampt im Umgang mit gefährlichen und illegalen Produkten, hat heute die EU-Kommission festgestellt. Nach X handelt es sich um den zweiten Online-Dienst, der gegen den Digital Services Act verstoßen hat. Von Tomas Rudl –

Artikel lesen

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Hype um Prognosemärkte hält an: Wetten, dass Familie Trump gewinnt

Während weltweit immer mehr Länder Prognosemärkte als Glücksspiel behandeln, baut die Trump-Regierung ihre Aufsichtsbehörde zum Anwalt der Branche um. In den USA sollen Krypto- und Prognosemärkte so unreguliert wie möglich wachsen können – und Familie Trump profitiert mit. Von Denis Glismann –

Artikel lesen

Statt Durchsetzung von Völkerrecht: EU-Mittelmeermission IRINI dient künftig nur noch der Migrationsabwehr

Griechenland und Frankreich lassen das UN-Mandat der Mittelmeermission IRINI gegen Waffenlieferungen auslaufen. Stattdessen unterstützt die EU nun auch das abtrünnige Ostlibyen mit Überwachungstechnik und der Ausbildung libyschen Personals, das dann Flüchtlingsboote abfangen soll. Von Matthias Monroy –

Artikel lesen

TikTok, Instagram, Youtube: Plattformen schludern bei Hassrede und Accountsperren

Wenn Social-Media-Plattformen zu viel oder zu wenig löschen, können sich Nutzer:innen beim Appeals Centre Europe beschweren. In mehr als 1.700 Fällen hielten die Schlichter:innen die Entscheidungen der Tech-Konzerne für falsch. Sie bemängeln „markante und immer wiederkehrende Probleme“. Von Denis Glismann –

Artikel lesen

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Wenn Social-Media-Plattformen zu viel oder zu wenig löschen, können sich Nutzer:innen beim Appeals Centre Europe beschweren. In mehr als 1.700 Fällen hielten die Schlichter:innen die Entscheidungen der Tech-Konzerne für falsch. Sie bemängeln „markante und immer wiederkehrende Probleme“.

Plattformen setzen ihre eigenen Regeln gegen Hassrede, Gewalt und Kriminalität im Netz nur lückenhaft durch. Das geht aus dem zweiten Transparenzbericht des Appeals Centre Europe hervor, der Dubliner Streitbeilegungsstelle, über die man in der EU Moderationsentscheidungen von Social-Media-Plattformen anfechten kann. In 70 Prozent der geprüften Streitfälle, in denen Plattformen gemeldete Hassrede online gelassen hatten, hätte der Inhalt nach Auffassung des Zentrums gelöscht werden müssen. Bei Gewalt und Kriminalität waren es 75 Prozent.

Bei mehr als 1.400 geprüften Hassrede-Entscheidungen widersprach das Appeals Centre Europe am häufigsten TikTok: In 83 Prozent der Fälle, in denen die Plattform gemeldete Hassrede online gelassen hatte, hielt das Zentrum dies für falsch. Es folgen Instagram mit 74 Prozent, Facebook mit 61 Prozent und YouTube mit 58 Prozent. Die strittigen Inhalte richteten sich unter anderem gegen Migrant:innen, religiöse Minderheiten, Rom:nja und queere Menschen.

Das Zentrum erkennt inzwischen wiederkehrende Muster, die auf eine fehlerhafte Umsetzung der Plattformrichtlinien hindeuten – in beide Richtungen. Einerseits bleibt gemeldete Hassrede zu oft online: Ging es um Inhalte, die eine Plattform stehen gelassen hatte, kam das Zentrum in 63 Prozent der geprüften Fälle zu dem Schluss, dass sie hätten entfernt werden müssen. Andererseits löschen die Plattformen Inhalte, die gegen keine Regel verstoßen: Ging es um entfernte Inhalte, entschied das Zentrum in 52 Prozent der Fälle, dass die Löschung nicht hätte erfolgen dürfen. Bezog sich das Entfernen von Inhalten auf eingeschränkte Waren und Dienstleistungen, hielt das Zentrum die Löschung in 65 Prozent der Fälle für unberechtigt.

Der Transparenzbericht nennt auch die Zahl der gemeldeten Fälle. Zwischen April 2025 und März 2026 gingen demnach mehr als 24.000 Beschwerden ein – rechnerisch alle 22 Minuten eine. Nur etwa die Hälfte davon fiel in den Zuständigkeitsbereich der Stelle. Im März 2026 erhielt das Zentrum neunmal so viele zulässige Fälle wie ein Jahr zuvor.

Das Appeals Centre Europe ist eine unabhängige außergerichtliche Streitbeilegungsstelle, die nach Artikel 21 des EU-Gesetzes über digitale Dienste (Digital Services Act, DSA) zertifiziert ist. Über sie können Personen und Organisationen in der EU Entscheidungen von Social-Media-Plattformen anfechten, ohne vor Gericht zu ziehen. Aktuell bearbeitet die Stelle Streitfälle zu Facebook, Instagram, Pinterest, Threads, TikTok und YouTube.

Plattformen rücken strittige Inhalte nicht raus

Inhaltlich prüfen kann das Zentrum eine Beschwerde jedoch nur, wenn die Plattform den strittigen Inhalt auch herausgibt, was meistens nicht geschieht. Von mehr als 10.000 Entscheidungen konnte das Zentrum nur in knapp 3.000 Fällen die Inhalte tatsächlich überprüfen – dort widersprach es der Plattform in 59 Prozent der Fälle. In den übrigen mehr als 7.000 Fällen lieferte die Plattform die Inhalte nicht. In solchen Fällen bekommen Nutzer:innen automatisch recht.

Besonders ausgeprägt ist zudem das Problem mit gesperrten Konten, dem mit Abstand häufigsten Beschwerdetyp. Bis März 2026 gingen dazu mehr als 14.000 Meldungen ein. Auch hier liefern die Plattformen oft gar nicht erst die Inhalte, die eine Überprüfung möglich machen würden. Bei mehr als 4.600 zulässigen Beschwerden über gesperrte Facebook- und Instagram-Konten legte Meta laut Bericht nur in weniger als 100 Fällen die nötigen Inhalte vor. In den wenigen Fällen, die das Zentrum tatsächlich prüfen konnte, gab es den Nutzer:innen jedoch nur in etwa einem Drittel der Fälle recht.

Durchsetzen lassen sich die Entscheidungen des Appeals Centre Europe allerdings nicht. Die Plattformen müssen sich zwar mit ihnen befassen, ihnen aber nicht folgen. Allein bei den mehr als 1.000 Hassrede-Entscheidungen, die zivilgesellschaftliche Organisationen angestoßen hatten, kenne das Zentrum nur eine Handvoll Fälle, in denen eine Plattform die Entscheidung tatsächlich umsetzte. In den übrigen sei sie abgelehnt oder ignoriert worden. Die beanstandeten Inhalte blieben demnach online.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Griechenland und Frankreich lassen das UN-Mandat der Mittelmeermission IRINI gegen Waffenlieferungen auslaufen. Stattdessen unterstützt die EU nun auch das abtrünnige Ostlibyen mit Überwachungstechnik und der Ausbildung libyschen Personals, das dann Flüchtlingsboote abfangen soll.

Vor sechs Jahren startete die Europäische Union ihre Mittelmeermission IRINI zur Durchsetzung des Waffenembargos gegen Libyen. Grundlage war ein entsprechendes UN-Mandat. Mit dessen Umsetzung sollte EU-Militär auch zur Stabilisierung Libyens und zum politischen Friedensprozess beitragen. Nach dem Sturz von Muammar al-Gaddafi kämpfen dort seit 15 Jahren zwei verfeindete Regierungen in Tripolis und Benghazi mit ihren Milizen um Einfluss.

Mehrere Mitgliedstaaten, darunter auch Deutschland, entsenden in IRINI Schiffe, U‑Boote, Flugzeuge oder Drohnen vor die Küsten Nordafrikas. Mit dem Auslaufen des UN-Mandats am Montag dieser Woche erlischt aber die rechtliche Grundlage für Schiffskontrollen auf hoher See. Trotzdem wird die EU-Mission nicht beendet – sondern zu einer komplett anderen Operation umgebaut. Im Mittelpunkt steht nun die Migrationsabwehr, die bislang nur als Nebenaufgabe rangierte. Dazu wird nun auch der abtrünnige Osten Libyens eingebunden.

Neue Details stehen in einem aktuellen Ratsdokument, über das die britische Nichtregierungsorganisation Statewatch am Donnerstag berichtete. Der dazu veröffentlichte Entwurf für ein technisches Abkommen soll dem militärischen Komitee der „Europäischen Friedensfazilität“ in Brüssel zur Abstimmung vorgelegt werden.

Das Dokument listet auf, was unter den Kapazitätsaufbau fallen kann – und hält sich dabei alle Optionen offen: Verbesserung, Instandsetzung, Ausstattung oder operative Befähigung maritimer Koordinationsstrukturen, „einschließlich, aber nicht beschränkt auf Seenotleitstellen, Kommunikationseinrichtungen und andere als prioritär eingestufte operative Infrastruktur“. Welche Milizen in Ostlibyen konkret von der EU-Unterstützung profitieren sollen, lässt der Vertragsentwurf aber offen.

Schnellverfahren für neue Abschottung

Hintergrund der Neugestaltung von IRINI ist ein Antrag Italiens für ein „Projekt mit rascher Wirkung“. Die Möglichkeit solcher „Quick Impact Projects“ wurde erstmals im vergangenen Jahr im erneuerten Mandat der Militärmission verankert. Der Vorteil: Beschlüsse und Umsetzung der Maßnahmen können in Brüssel auf kürzeren Wegen erfolgen.

In dem nun vorliegenden Entwurf für ein technisches Abkommen zwischen IRINI und den libyschen Behörden für Strafverfolgung und Seenotrettung werden vor allem Ausrüstungs- und Trainingsprogramme geregelt. Demnach soll IRINI in der östlichen Hauptstadt Benghazi ein maritimes Lagezentrum (Maritime Rescue Co-ordination Centre, MRCC) errichten und in Tobruk einen Überwachungsturm mit Radar- und Sensortechnik. Beides soll dauerhaft in libyschen Besitz übergehen.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Vorbild ist eine Struktur, die Italien mit Geldern aus Brüssel ab 2017 in Tripolis errichtet hat. Eine dort neu geschaffene Seenotleitstelle kann von den Küstenwachen der europäischen Mittelmeeranrainer angerufen werden, um Bootsflüchtlinge nach Libyen zurückzuholen – was nach offizieller Lesart nicht gegen das Verbot der Zurückweisung von Schutzsuchenden verstößt: In Libyen sind Misshandlung, Folter und Tod von Geflüchteten an der Tagesordnung, wie NGOs und auch die Vereinten Nationen regelmäßig berichten.

Pullbacks statt Pushbacks

Ein solches Pushback-Verbot hatte der Europäische Menschenrechtsgerichtshof in einem wegweisenden Urteil 2012 für alle EU-Staaten vorgegeben. Auch Agenturen wie etwa Frontex müssen sich daran halten.

Wenn nun aber libysche Milizen alarmiert, Menschen dann auf hoher See abgefangen und wieder nach Libyen zurückgebracht werden, handelt es sich aus Sicht von Kritiker*innen um Pushbacks durch die Hintertür. Diese werden deshalb als Pullbacks bezeichnet. Die EU-Grenzagentur Frontex übernimmt dabei die Luftaufklärung, da Libyen selbst über keine Flugzeuge oder Hubschrauber verfügt.

Die Neukonfiguration von IRINI geht vor allem auf Griechenland und Frankreich zurück, die 2016 die Sicherheitsratsresolution 2292 zum Waffenembargo gegen Libyen entworfen hatten. Die beiden Regierungen beantragten dieses Jahr keine Verlängerung mehr. Was bleibt, ist eine reine EU-Mission ohne völkerrechtliche Befugnisse.

Annäherung an Haftars Ostlibyen

Die EU umgarnt nun Ostlibyen, das bislang hauptsächlich von den EU-Schiffskontrollen betroffen war. Diese politische Schlagseite steht dem EU-Ziel entgegen, eine neu entstandene Fluchtroute aus Ostlibyen nach Kreta einzudämmen. Hier verfolgt Brüssel eine sogenannte „Ein-Libyen-Politik“, bei der die Rivalität der Hauptstädte Tripolis und Benghazi mit Geld und Aktivität übertüncht wird.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Die nun vom neuen „Quick Impact Project“ begünstigten Städte Benghazi und Tobruk liegen im Herrschaftsgebiet von General Khalifa Haftar, der einst den Bürgerkrieg gegen die international anerkannte Regierung in Tripolis begann. Die Anschubfinanzierung für das MRCC in Benghazi soll drei Millionen Euro betragen. Weitere Kosten für die auf 18 Monate angesetzte Implementierungsphase übernimmt wie im Westen Libyens Italien.

Im Gegenzug erhalten die Grenzbehörden der EU-Staaten – und wohl auch Frontex – regelmäßige „taktische“ Informationen über Migrationsbewegungen. Für die Kommunikation zwischen IRINI und libyschen Kräften ist das existierende SMART-System vorgesehen, eine netzwerkbasierte Plattform für den Austausch maritimer Lagedaten, ergänzt durch Satelliten- und Funkkommunikation.

Keine Haftung für Menschenrechtsverletzungen

Die Ausbildung des libyschen Personals soll auf IRINI-Schiffen erfolgen, weitere Trainings sind in EU-Ausbildungszentren an Land sowie direkt in Libyen geplant. Die Kurse umfassen Kenntnisse über IT-Systeme für maritime Lagezentren, Boardingverfahren und Radarführung. Für alle Beteiligten ist außerdem ein einstündiger Menschenrechtskurs vorgesehen.

Auch die deutsche Marine dürfte sich daran beteiligen wollen. Die Bundesregierung hatte dazu letztes Jahr die Unterstützung und Ausbildung der libyschen Küstenwache trotz NGO-Protest wieder in das Mandat aufgenommen – obwohl deren Milizen wiederholt schwere Menschenrechtsverletzungen gegenüber Geflüchteten und zivilen Seenotretter*innen im Mittelmeer begehen.

Der nun bekannt gewordene Vertragsentwurf sieht zwar vor, dass IRINI das Verhalten der ausgebildeten Kräfte beobachtet. Dazu sind unter anderem Besuche in Libyen vorgesehen. IRINI soll aber keinerlei Verantwortung für das Gebaren der libyschen Milizen übernehmen: Das Monitoring begründe keine Verantwortung für Entscheidungen libyscher Behörden, keine Haftung für laufende Einsätze und keine Weisungsbefugnis gegenüber libyschen Einheiten, heißt es im Entwurf.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Während weltweit immer mehr Länder Prognosemärkte als Glücksspiel behandeln, baut die Trump-Regierung ihre Aufsichtsbehörde zum Anwalt der Branche um. In den USA sollen Krypto- und Prognosemärkte so unreguliert wie möglich wachsen können – und Familie Trump profitiert mit.

Wird Trump am 31. Mai tanzen? Die Chance steht laut Polymarket bei acht Prozent. Werden Frankreich, Großbritannien oder Deutschland den Iran bis zum 30. Juni angreifen? Die Chance steht bei drei Prozent.

Der Hype um Prediction Markets (deutsch: Prognosemärkte) hält an. Im April berichtete netzpolitik.org, wie das ethisch höchst fragwürdige und manipulationsanfällige Wettangebot immer populärer wird. Die beiden größten Plattformen Polymarket und Kalshi boomen: Zusammen verzeichneten sie im Jahr 2025 ein Handelsvolumen von rund 50 Milliarden US-Dollar. Im Jahr 2026 erreichten beide Plattformen zusammen dieses Volumen bereits im Frühjahr.

Die Plattformen unternehmen derweil große Anstrengungen, um auch Investmentfirmen und Hedgefonds für sich zu gewinnen. Auf Kalshi sei das Handelsvolumen institutioneller Anleger in den vergangenen sechs Monaten um 800 Prozent gestiegen, berichtet Reuters. Geht es nach den Plattformen, sollen ihre Angebote als legitime Anlageklassen neben anderen Finanzprodukten gelten.

Viele Staaten sehen das anders. Weltweit greifen immer mehr Länder gegen die Plattformen durch. So sperrte kürzlich Indonesien den Zugang zu Polymarket, nachdem auf der Plattform darauf gewettet wurde, ob und wann der indonesische Präsident seines Amtes enthoben wird. Einen Tag später verhängte auch Spanien eine Netzsperre gegen Polymarket und Kalshi und leitete zusätzlich Verfahren ein, weil die Plattformen ohne Glücksspiellizenz im Land aktiv gewesen sein sollen. Erst im April hatte Brasilien die Seiten gesperrt sowie die Regeln für „wett-ähnliche“ Produkte verschärft.

In Deutschland bleibt Polymarket dagegen im Netz frei zugänglich. Dort Wetten anzubieten oder daran teilzunehmen ist laut der Gemeinsamen Glücksspielbehörde der Länder jedoch strafbar. Eine einheitliche EU-Regelung für Prognosemärkte gibt es derweil nicht.

Die Reaktionen der unterschiedlichen Länder auf die Prognosemärkte eint dennoch eines: Sie sehen in den Ereigniswetten kein Anlageprodukt, sondern ein Glücksspiel – und gehen deshalb unter der Maßgabe von Glücksspielgesetzen gegen das Wettangebot vor.

US-Aufsichtsbehörde wird zum Anwalt der Branche

Ganz anders dagegen die USA. Dort gehen bislang nur einzelne Bundesstaaten gegen die Wetten vor. Der bisher umfangreichste Vorstoß kommt aus Minnesota. Dort sollen Prognosemärkte ab August verboten sein. Der US-Bundesstaat will damit vor allem junge Menschen schützen, die laut Studienlage zur primären Zielgruppe gehören. Der Generalstaatsanwalt von Minnesota, Keith Ellison, sagte in einer Stellungnahme, Prognosemärkte zielten auf Menschen mit geringem Einkommen und seien so konzipiert, dass sie süchtig machen. „Sie tragen dazu bei, dass die Superreichen noch reicher werden und der Rest von uns noch ärmer wird.“ Das Glücksspiel und die finanziellen Verluste gingen so immer früher los, erklärte er.

Trump hingegen fährt eine andere Linie. Die Gouverneure von Illinois und Minnesota, JB Pritzker und Tim Walz, bezeichnete er als „Abschaum“, dem man das Festlegen der Regeln nicht überlassen dürfe. Ihm zufolge müsse die ausschließliche Zuständigkeit der „Commodity Futures Trading Commission“ (CFTC) für Prognosemärkte gewahrt bleiben, damit diese Märkte ungehindert wachsen können.

Der demokratische Gouverneur von Illinois JB Pritzker bot eine andere Lesart an: „Der korrupteste Präsident in der Geschichte unseres Landes will sicherstellen, dass unsere Bundesstaaten die Prognosemärkte nicht regulieren können, damit seine Familie und seine Regierung weiterhin davon profitieren können.“ 16 verschiedene Bundesstaaten greifen aktuell zu rechtlichen Schritten gegen die Plattformen. Die CFTC verklagte bereits sechs davon.

Einem aktuellen Bericht der New York Times zufolge hat die CFTC in den vergangenen 16 Monaten der Trump-Administration den Plattformen praktisch bei jeder Gelegenheit juristisch unter die Arme gegriffen. Die Behörde habe unter anderem eigenes Personal abgebaut und kritische Beamte in den Zwangsurlaub geschickt sowie interne Ermittlungen gegen jene Mitarbeitende angestrengt, die unbequeme Fragen stellten – beispielsweise hinsichtlich der Geschäftsbeziehungen zwischen der Krypto-Börse Crypto.com und Trump Media & Technology Group, Trumps Medienunternehmen.

Analog dazu habe die CFTC die Durchsetzung der Rechtsvorschriften in der Krypto-Branche drastisch eingeschränkt und systematisch erfahrene Beamte entlassen, so der Bericht. Die Maßnahmen seien gegenüber den Beamten nicht begründet worden, aber die Botschaft klar gewesen: Macht diesen Branchen keinen Ärger.

Die CFTC versteht Prognosemärkte als bundesrechtlich regulierte Finanzmärkte und ihre Wettangebote als sogenannte „Event Contracts“. Also als ein Finanzprodukt neben anderen Finanzderivaten. Entsprechend sieht die Behörde die Zuständigkeit bei sich und nicht etwa bei den Glücksspielaufsichten einzelner US-Bundesstaaten. Der Begriff „Wette“ taucht in diesem Zusammenhang kein einziges Mal auf der Webseite der Behörde auf.

Das Geschäft der Familie Trump

Wer die CFTC führt, kommt heute selbst aus der Industrie, die sie beaufsichtigen soll. Im Januar 2025 ernannte Trump die Anwältin Caroline Pham zur Vorsitzenden der Kommission. Mit ihr begann der systematische Abbau von Regulierungen für Prognose- und Kryptomärkte. Sie drängte etwa auf die Einstellung eines Verfahrens gegen die Krypto-Börse KuCoin. Diese war kurz zuvor eine Partnerschaft mit dem Krypto-Unternehmen World Liberty Financial eingegangen, das wiederum der Familie Trump gehört. Inzwischen ist Pham als Chefjuristin sowie Verwaltungschefin bei der Kryptofirma MoonPay tätig, einem Geschäftspartner von Polymarket.

Ursprünglich sollte anschließend Brian Quintenz den CFTC-Vorsitz übernehmen. Doch Trump zog seine Nominierung zurück, nachdem Quintenz sich Ende 2025 den Zorn der Eigentümer der Krypto-Börse Gemini zugezogen hatte, berichtet Politico. Diese sind ebenfalls Geschäftspartner der Familie Trump.

Im Dezember 2025 ernannte Trump schließlich Michael Selig in die Kommission. Er war zuvor als Anwalt für Unternehmen beider Branchen tätig: Krypto- und Prognosemärkte. Pham schied aus und weil Trump die übrigen vier kommissarischen Posten der CFTC unbesetzt lässt, wurde Selig faktisch Alleinentscheider der Aufsichtsbehörde. Wo die Webseite der CFTC fünf Mitglieder behauptet, prangt dort tatsächlich nur ein Gesicht. Ob bei Klagen gegen die US-Bundesstaaten oder neuen Regeln für die Unternehmen: Eine Person entscheidet, wie die CFTC verfährt. Er mache einen „großartigen Job“, sagte Trump auf seiner Plattform Truth Social über Selig.

Und der muss es wissen, denn seine Familie steckt tief in beiden Branchen. Trumps börsennotiertes Medienunternehmen Trump Media & Technology Group kündigte im vergangenen Jahr eine eigene Prognosemarkt-Plattform an: Truth Predict. Der älteste Sohn des Präsidenten, Donald Trump Jr., berät sowohl Polymarket als auch Kalshi. Seine Investmentfirma 1789 Capital ist ein Investor bei Polymarket.