netzpolitik.org

Bitte aktualisieren Sie PHP auf Version 8.2.0 (zurzeit: 8.1.2-1ubuntu2.23). Info

Lehrvideos über Gefahren im Straßenverkehr sind genauso notwendig wie der Versuch, immer sicherere Autos zu bauen. Digitale Risiken sind im Vergleich dazu noch mal besonders, denn sie haben eine weitere Risikokomponente. Verknüpft damit ist eine gesamtgesellschaftliche Aufgabe.

Die heutige Degitalisierung möchte ich mit einer Erinnerung aus meiner Kindheit einleiten. Es müsste in der ersten Klasse gewesen sein, da passierte in der Schule etwas Besonderes: Der Videowagen, sehr selten genutzt, wurde in ein großes Klassenzimmer gefahren und zwei Schulklassen sammelten sich vor einem Fernseher. Es wurde eine Videokassette in den VHS-Player geschoben und ein Film in ziemlich hartkontrastigem Schwarz-Weiß wurde abgespielt. Was folgte, war ein uns Kinder durchaus aufrüttelnder Film. In ein paar Minuten wurde uns Kindern erklärt, wie gefährlich es sein kann, in fremde Autos zu steigen. Gefahr der Kindesentführung, nicht machen, liebe Kinder. Dass ich mich heute noch an Teile dieses Films und den Vorführungskontext so genau erinnern kann, zeigt doch zumindest, dass der Film eine Wirkung auf uns Kinder gehabt haben muss.

Ich bin inzwischen kein Kind mehr, was allein schon aus der Beschreibung von Videokassetten klar werden sollte. Videokassetten im VHS-Format sind ein Aufzeichnungs- und Wiedergabesystem aus den 1970er-Jahren. Viele von den Kindern bis Minderjährigen, die heute von Social Media abgehalten werden sollen, durch Altersverifikation mit teils absurd in die Intimsphäre eingreifenden Methoden, haben solche klobigen Kassetten vielleicht noch nie zu Gesicht bekommen und das Klackern und Surren beim Einlegen einer solchen Kassette nie gehört.

Wenn ich meine Erinnerungen an die Schulzeit in Gedanken über die Jahre weitergehe, kommt mir dann der Fahrradführerschein in der vierten Klasse in den Sinn. Ging es doch auch dabei darum, Kindern beizubringen, wie sie sich sicher eigenständig im Straßenverkehr mit Fahrrädern bewegen können. Auch hier wurde viel Aufwand betrieben. Ganze Schulklassen wurden mit einem extra bestellten Bus zum nächsten Fahrradübungsplatz gefahren und durften dort im Kleinen Situationen im Straßenverkehr simulieren, um dann hoffentlich möglichst sicher auf echten Straßen unterwegs zu sein.

Ein paar Jahrzehnte später bin ich diesen pädagogischen Maßnahmen dankbar. Weil ich bisher keine kritischen Konfliktsituationen hatte, bei denen Autos eine Rolle spielten. Sei es durch eine nie stattgefundene Entziehung Minderjähriger nach § 235 StGB, wie das kleine Kind von damals, das jetzt wohl als Erwachsene nennen sollte, noch durch Unfälle im Straßenverkehr auf Fahrrädern. Es ist nicht klar nachweisbar, ob es konkret die Erziehung war, die all diese kritischen Situationen vermieden hat. Sie hatte aber zumindest im Sinne eines Präventionsparadoxons, also dem Gar-nicht-Entstehenlassen solcher kritischen Situationen, einen Anteil.

Digitalpädagogik

2026 vermisse ich einen vergleichbaren Ansatz von umfassender Digitalpädagogik, wenn wir die Versuche von Gefahrenprävention in Bezug auf den Straßenverkehr mit dem Digitalen in Relation setzen. Aber automobile Individualmobilität gibt es auch eher schon seit mehr als hundert Jahren und dieses Internet ist ja immer noch Neuland.

Wie neuartig dieses Digitale und seine Gefahren immer noch sind, zeigt sich zum Beispiel bei Julia Klöckner, als Bundestagspräsidentin immerhin im zweithöchsten politischen Amt in diesem Land. Julia Klöckner ist digital gesehen in gewisser Weise, rein bildlich gesprochen, ganz unbedarft in ein fremdes Auto eingestiegen und ihr Account wurde dann eben entführt.

Nun ist es eine mögliche Reaktion, eine eher schadenfrohe Haltung Julia Klöckner gegenüber einzunehmen oder anderen wohl auch betroffenen Teilen der Bundesregierung. Zumal Warnungen zu Phishing-Kampagnen ja durchaus seit längerem ausgesprochen wurden. Eigentlich auch schon seit Januar, zumindest nach Lektüre der relevanten Onlinemedien wie diesem hier.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Allerdings wäre das ja nicht besonders erwachsen und ich bin ja kein schadenfrohes Kind mehr. Inzwischen bin ich im Bereich digitaler Kompetenzen ja digitale Erklärbärin – Eigenaussage meiner Webseite –, versuche immer wieder, nicht nur Technik zu erklären, sondern vor allem auch die Technikfolgen. Manchmal braucht es dazu auch eine sehr plastische, anschauliche Demonstration der Gefahren und möglichen Folgen schlechter Digitalisierung und manchmal sagen sogar ehemalige Teile der Bundesregierung, dass sie im Digitalen viel gelernt hätten. Das passiert aber oftmals erst, nachdem etwas passiert ist.

Im Falle Signal passiert aber erstaunlich wenig Selbstreflexion der Betroffenen. Vielmehr wird die Lösung in Verantwortung anderer gesucht. Signal will in Zukunft etwa selbst mehr gegen Phishing unternehmen. Der Bundestag sucht für sich die Lösung gleich in einem anderen Messenger, nämlich Wire.

Oberflächliche Diskussionen

Aus rein technischer Sicht könnte jetzt eine sehr nerdige Diskussion über die Sicherheit von Messengern und das damit verbundene Sicherheitsrisiko für Nutzer*innen entbrennen. Telefonnummern für die Nutzung wie bei Signal, wenn auch inzwischen nur zum Onboarding, seien ja ein Sicherheitsrisiko per se und E‑Mails wie bei Wire seien ja viel besser. BSI-Zertifizierungen hätte ja nur Wire, aber auch nur befristet bis 2028, weil im Gegensatz zu Signal ist das ja nicht Post-Quanten…

Wire im Speziellen hat nach dem Hack auf Julia Klöckner die Gunst der Stunde genutzt und genau so eine Diskussion aufgemacht: Guck, hier ist ein besseres Produkt, weil dies und das und mehr souverän. Wire sei ganz anders, speziell für Unternehmen gedacht und so weiter.

Am Ende folgt dann zwar immer das Mantra, dass es ja keine absolute Sicherheit gebe. Ich halte die Diskussion zu diesem Zeitpunkt für falsch und eher für einen Lobbyismus-Vorstoß, um ein weiteres Produkt mit ähnlichen Problemen zu verkaufen. Gesamtgesellschaftlich ist damit wenig gewonnen, der Gewinn steigt nur für die dahinterstehenden Unternehmen. Julia Klöckner hat auch brav die Marketing-Stichpunkte von Wire im Bundestag versendet, so wirkt es zumindest von der Wortwahl her. Wire hat sich ebenso als Teil der supergeheimen KI‑Hypermega-Deutschland-App von SAP und Telekom platziert.

Nun ist es ja so, dass ich durchaus ein ganz klein wenig Erfahrung mit Informationssicherheit habe. Die Diskussionen speziell nach dem Signal-Vorfall innerhalb der Bundesregierung sind nur beschränkt nützlich. Denn Angriffe, etwa auch auf Signal, finden nach wie vor statt und schwappen weiter durch die Chatgruppen, sogar exponentiell [€] steigend. Signal wird an der ein oder anderen Stelle ein wenig am User-Interface und an Interaktionen schrauben. Es gibt öffentliche Interviews im Spiegel [€], in denen Besserung gelobt wird. Sichere Systeme sind immer ein erstrebenswertes Ziel, speziell nach Vorkommnissen wie jüngst.

Die Journalistin Eva Wolfangel hat etwa 2023 schon auf der re:publica zum Ausdruck gebracht, dass der Mensch nicht das Problem ist. Auf Phishing hereinzufallen, ist menschlich möglich und nicht vollständig verhinderbar. Es ist unabdingbar, immer weiter an per Design sicheren, aber gleichzeitig menschenzentrierten digitalen Lösungen zu arbeiten. Das wird aber allein nicht reichen.

So seltsam es klingen mag: Lehrvideos, die über die Gefahren von digitalen Tools aufklären, sind in gewisser Weise genauso notwendig wie der Versuch, immer sicherere Autos und sonstige Fortbewegungsmittel zu bauen, aber gleichzeitig Erziehung für den Straßenverkehr zu leisten. Ein kurzer Blick zum Vergleich auf die Gefahren im Straßenverkehr: Die Zahl der Unfälle im Straßenverkehr sinkt seit Jahrzehnten. Das liegt an besserer Technik und immer noch stattfindender Aufklärung. Nur gibt es diese Bildung für den Straßenverkehr eben schon ein paar Jahrzehnte und im Lehrplan ist sie seit langem institutionalisiert, wie etwa im Bildungsplan in Baden‑Württemberg.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Das Digitale als solches ist eine Domäne, bei der die digitale Bildung ebenso wie die digitalen Möglichkeiten im ständigen Wandel sind. Es ist gut, informationstechnische Lerninhalte in die schulische Laufbahn zu integrieren. Leider wird davon aber eine Bundesregierung nicht gleich phishingresistent. Lebenslanges Lernen im Digitalen ist für die gesamte Bevölkerung notwendig, nur drüber reden hilft allein genau nichts. Kompetenzbildung im Digitalen ist eine höchstindividuelle Aufgabe, von einer Bundestagspräsidentin bis zu jedem Schulkind.

Nur sind digitale Risiken auf politischer Ebene doch besonders, denn sie haben eine weitere Risikokomponente.

Der demokratische Anteil

Der Gedanke, dass der Bundestag oder die Bundesbehörden mit Lösungen wie Wire Bund in verschiedenen Netzen wie den Netzen des Bundes vertraulich kommunizieren können, mag erst einmal eine logische Schlussfolgerung sein. Vertrauliche politische Kommunikation durch vertraulichen, geschlossenen Rahmen.

Er greift aber zu kurz. Längst sitzen die Feinde der Demokratie nicht mehr außerhalb der Politik, sie haben inzwischen Zugang zu politischen Strukturen, sind Teil von Parteien und sitzen in unterschiedlichen Parlamenten. Der Gedanke, dass die Abschottung besonders schützenswerter politischer Kommunikation weitere Sicherheit bringe, greift in einer Welt viel zu kurz, in der die Demokratie durch Feinde der Demokratie von innen heraus angegriffen wird.

Dieses Risiko der demokratiefeindlichen politischen Einflussnahme einzudämmen, auch im digitalen Raum, ist leider keine rein technische Frage mehr, es ist eine gesamtgesellschaftliche Aufgabe. Bemerkenswert dabei ist aber, dass gerade die demokratischen Parteien im Ringen um mehr innere Sicherheit noch viel mehr Systeme schaffen, bei der sich eine demokratiefeindliche Übernahme besonders lohnen wird: Verhaltensscanner in Kombination mit Gesichtserkennung, Vorratsdatenspeicherung, Schatten-IT durch Europol oder Empfehlungen, Virtual Private Network Anbieter (VPNs) zu regulieren, weil diese übergreifende Online-Alterskontrollen unterwandern könnten…

Wenn die Phishing-Angriffe auf Signal eines sein sollten, dann mehr als eine rein technische Warnung. Sie sollten auch eine Warnung sein, dass unsere Demokratie und unsere Grundrechte eben auch durch unkluges digitalpolitisches Verhalten bedroht sind. Baut man in Demokratien übermäßige Überwachungsstrukturen, lohnt es sich umso mehr, dass uns irgendwann irgendwer unsere Demokratie mit dem vermeintlich gut gemeinten Überwachungsapparat entführt. Danach hilft leider auch kein Account-Reset mehr.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

netzpolitik.org im Fit-Check: Nach mehr als neun Jahren im immer gleichen Outfit hat unsere Seite einen neuen Look. Warum musste das sein und was hat’s an Nerven gekostet? Darüber sprechen wir in dieser Folge mit Ingo und Anna.

Es ist schwer zu übersehen, wenn ihr diesen Text auf unserer Website lest: netzpolitik.org hat einen neuen Look. Nach mehr als neun Jahren, in denen sich unsere Seite optisch und auch funktional kaum verändert hat, haben wir jetzt ein neues Design. Und auch unter der Haube hat sich einiges getan.

In dieser Folge Off The Record schauen wir gemeinsam mit anna und Ingo zurück auf die verschiedenen visuellen Stadien, die netzpolitik.org durchlaufen hat. Wir sprechen über neue Features, über die wir uns besonders freuen, verraten, warum am Tag der Umstellung alles noch ein paar Stunden länger gedauert hat als erwartet – und womit wir die Zeit überbrückt haben.

In dieser Folge: Anna Biselli, Ingo Dachwitz und Chris Köver

Produktion: Serafin Dinges.

Titelmusik: Trummerschlunk.

Hier ist die MP3 zum Download. Wie gewohnt gibt es den Podcast auch im offenen ogg-Format. Ein maschinell erstelltes Transkript gibt es im txt-Format.

Unseren Podcast könnt ihr auf vielen Wegen hören. Der einfachste: in dem Player hier auf der Seite auf Play drücken. Ihr findet uns aber ebenso bei Apple Podcasts, Spotify und Deezer oder mit dem Podcatcher eures Vertrauens, die URL lautet dann netzpolitik.org/podcast.

Wir freuen uns auch über Kritik, Lob, Ideen und Fragen entweder hier in den Kommentaren oder per E‑Mail an podcast@netzpolitik.org.

Links und Infos

Blattkritik & Hausmitteilungen

- Der Beitrag von Ingo und Timur zur Konferenz „Cables of Resistance“: Wo sich lokaler Widerstand gegen den KI-Hype formiert

- Annas Beitrag zu alternativen Wander-Apps: Frei und dezentral ins Grüne

- Der von Chris und Sebastian veröffentlichte Teil des Gesetzentwurfs zu digitaler Gewalt: Diese Deepfakes sollen künftig strafbar sein

- Der hektisch verfasste Beitrag von Chris zum Gesetzentwurf zu Digitaler Gewalt: Mit Vorratsdatenspeicherung gegen digitale Gewalt

- Der Beitrag von Denis zu Prediction Markets: Wetten, dass Jesus vor 2027 zurückkehren wird

- Das Investigativjournalismus Fellowship von Netzwerk Recherche und den Neuen deutschen Medienmacher*innen, das unser Kollege Timur bekommen hat

- Unser aktueller Transparenzbericht zum 1. Quartal 20206: Unsere Einnahmen und Ausgaben – und viele kleine Lagerfeuer

Thema des Monats

- Post zu unserem Relaunch: Alles so schön neu hier

- Insta-Post zu den bisherigen optischen Stadien von netzpolitik.org: Das netzpolitik.org-Webdesign-Museum

Kapitel

(00:00:00) Begrüßung

(00:02:31) Blattkritik

(00:09:21) Hausmitteilungen

(00:13:00) Thema des Monats

(00:38:30) Credits

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die 19. Kalenderwoche geht zu Ende. Wir haben 19 neue Texte mit insgesamt 147.247 Zeichen veröffentlicht. Willkommen zum netzpolitischen Wochenrückblick.

Liebe Leser:innen,

nach einem Jahr schwarz-roter Bundesregierung wurde in dieser Woche viel Bilanz gezogen. Und die fiel nicht gut aus. Weder in den Medien noch auf der Straße.

Die Regierung liefere nicht, was sie versprochen hat, heißt es. Und sie müsse sich endlich zusammenraufen. Sonst drohe im Herbst ein böses Erwachen. Aus dem „Herbst der Reformen“ sei der „Sommer der Wahrheit“ geworden.

Ich habe in dieser Woche nachgeschaut, was wir selbst zum Start der schwarz-roten Koalition geschrieben hatten. Und was soll ich sagen: Mit Blick auf Überwachung und Grundrechteabbau hat die Regierung leider durchaus geliefert.

Biometrische Videoüberwachung, die Rückkehr der Vorratsdatenspeicherung, Fotofahndung im Netz, automatisierte Datenanalyse à la Palantir, zunehmende Intransparenz und rechtswidrige „Zurückweisungen“ von Schutzsuchenden. Das ist stringente Kontroll- und Ordnungspolitik, von den Innenstädten bis an die deutschen Außengrenzen.

Zivilgesellschaftliche Organisationen, Menschenrechtler:innen und die Kirchen lehnen die Vorhaben ab – als verfassungs- und europarechtswidrig. Die Regierung schert das wenig. Mehr noch: Wenn die Zahlen den Law-and-Order-Kurs nicht rechtfertigen, verweist sie kurzerhand auf die „gefühlte Sicherheit“. So geht Populismus.

Dabei bräuchten wir in Zeiten multipler Dauerkrisen ein anderes Sicherheitsverständnis, wie auch meine Kollegin Anna schreibt. Unter Sicherheit sollten demnach vollkommen andere Fragen fallen: Wie senken wir die Mieten? Wie sichern wir die Renten? Wie stoppen wir die Klimakatastrophe? Wie verbessern wir die Schulen? Wie machen wir unsere Städte lebenswerter? Wie unsere Demokratie resistenter?

Gegen solche Sicherheitsfragen habe ich nichts einzuwenden, im Gegenteil.

Um darauf Antworten zu finden, bräuchte es eine Kehrtwende. Doch ein „Sommer der Kehrtwende“ ist von dieser Koalition am wenigsten zu erwarten. Dafür müssen wir selbst ran: vor dem Bundesverfassungsgericht, auf der Straße oder an der Wahlurne.

Habt ein gutes Wochenende

Daniel

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Trugbild: Im Bann des Banalen

In den sozialen Medien präsentieren Content Creator alte Nazi-Architektur. Die beliebten Videos dienen mehr der Propaganda als der Aufklärung. Von Vincent Först –

Artikel lesen

Staatliches Hacken: Ermittler verwechseln Staatstrojaner mit Telefonüberwachung

Das Bundesjustizamt hat erneut falsche Zahlen zum Einsatz von Staatstrojanern veröffentlicht. Unsere Nachfrage ergab: Ermittlungsbehörden haben das Hacken von Geräten mit dem Abhören von Telefonaten verwechselt. Die selben Behörden führen die Überwachungsmaßnahme durch. Von Andre Meister –

Artikel lesen

FAQ: Das Überwachungspaket der Bundesregierung

Die schwarz-rote Koalition will ein Gesetzespaket verabschieden, das ein neues Zeitalter der Überwachung einläutet. Was steckt da konkret alles drin? Wir haben es durchgesehen, damit ihr es nicht tun müsst. Von Chris Köver, Markus Reuter, Martin Schwarzbeck –

Artikel lesen

Neue Welle: SPD, Linke und Grüne verlassen Musks Plattform X

Nach langer Diskussion kehren SPD, Linke und Grüne der Plattform X gemeinsam den Rücken. Sie begründen diesen Schritt mit Chaos und Desinformation auf Elon Musks Netzwerk. Viele der Accounts machen bei Bluesky weiter. Von Markus Reuter –

Artikel lesen

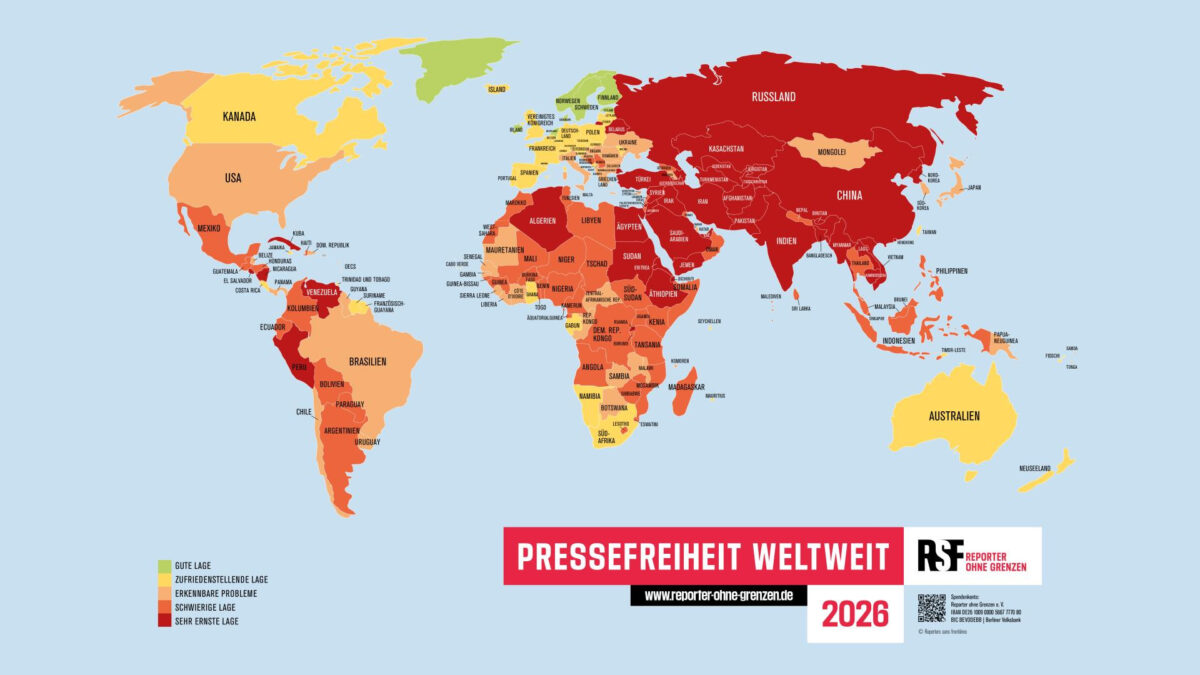

Konferenz für Menschenrechte: Druck aus China soll zu Absage der RightsCon geführt haben [Update]

Eine der wichtigsten Konferenzen zu digitalen Grund- und Menschenrechten sollte diese Woche in Sambia stattfinden. Doch die Veranstaltung in dem südafrikanischen Land wurde kurzfristig abgesagt. Die Veranstalter:innen erheben schwere Vorwürfe: Demnach ließ China wegen taiwanesischer Gäste die Muskeln spielen. Von Ingo Dachwitz –

Artikel lesen

Verhaltensscanner: „Eine reale Gefahr“

Gerade gibt es bundesweit Bestrebungen, Überwachungskameras mit Systemen zu koppeln, die vollautomatisiert erkennen, was die abgebildeten Menschen gerade tun. Davy Wang von der Gesellschaft für Freiheitsrechte erklärt, warum das eine schlechte Idee ist. Von Martin Schwarzbeck –

Artikel lesen

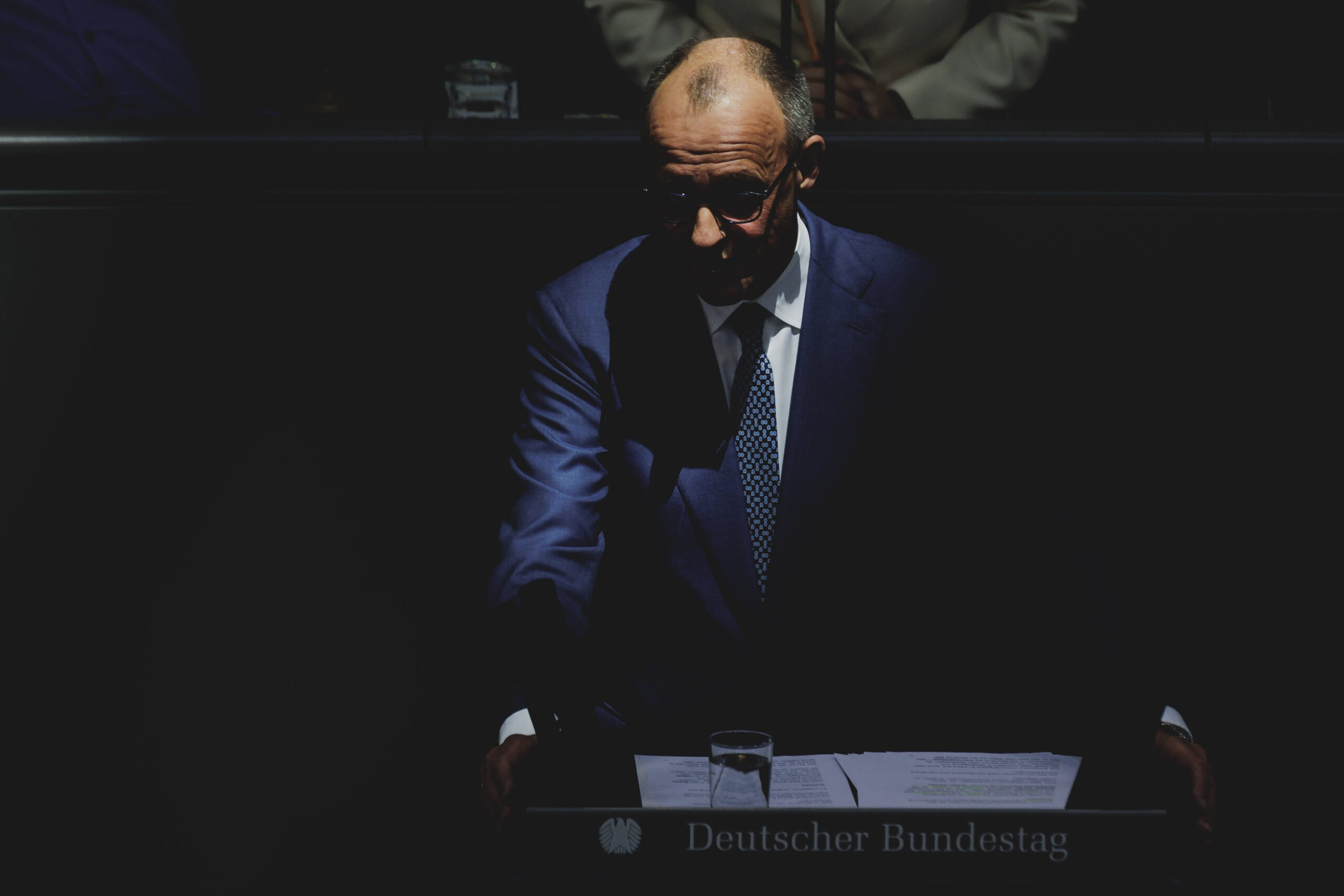

Ein Jahr Schwarz-Rot: „Neuer Tiefpunkt“ in Sachen Transparenz

Vom Lobby-Gipfel in den Alpen bis zum Buchhandlungspreis: Das erste Jahr Schwarz-Rot ist geprägt von skandalöser Intransparenz und zähem Ringen um Informationsfreiheit. Der vielleicht größte Umbruch: Unter Bundeskanzler Friedrich Merz ist Transparenz erstmals seit langem kein politisches Ziel mehr. Von Ingo Dachwitz –

Artikel lesen

Datenschutz Medienpreis: Auszeichnung für unsere Stalkerware-Recherche

Eine Recherche von Chris Köver und Martin Schwarzbeck wurde mit einem Sonderpreis bei der Verleihung des Datenschutz Medienpreises prämiert. Wir freuen uns sehr über die Auszeichnung und gratulieren den Kolleg:innen! Von netzpolitik.org –

Artikel lesen

Polizeigesetz Schleswig-Holstein: „Wie aus einem dystopischen Science-Fiction-Film“

Heute haben die Abgeordneten im Landtag von Schleswig-Holstein erstmals eine Novelle des Polizeigesetzes diskutiert. Es geht um Verhaltensscanner und Gesichtserkennung. Expert*innen zweifeln, ob das Gesetz verfassungsgemäß ist; die Opposition warnt vor einer Dystopie. Von Martin Schwarzbeck –

Artikel lesen

Anlasslose Massenüberwachung: Datenschutzbeauftragte kritisieren Chatkontrolle

Die Bundesdatenschutzbeauftragte warnt weiterhin vor der Chatkontrolle. Eine „anlasslose Massenüberwachung“ aller Bürger:innen „wäre in einem Rechtstaat beispiellos“. Auch die Datenschutzkonferenz fordert die EU-Gesetzgeber auf, die Chatkontrolle „endgültig abzusagen“. Von Markus Reuter –

Artikel lesen

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Europäische Kommission: In der Alterskontroll-App schlägt ein Herz von Google

Die Alterskontroll-App der EU- Kommission nutzt ein Verfahren von Google-Entwicklern. IT-Fachleute warnen vor Abhängigkeiten und Datenschutzrisiken – auch mit Blick auf die geplante EUDI-Wallet. Von Daniel Leisegang –

Artikel lesen

Correctiv-Recherche : Europol betreibt mutmaßlich illegale Datenanalyseplattformen

Die europäische Polizeibehörde Europol hat offenbar jahrelang eine Schatten-IT betrieben. Mitarbeitende sollen damit widerrechtlich große Mengen an personenbezogenen Daten durchsucht und ausgewertet haben. Dennoch will die EU-Kommission Europol nun mit deutlich mehr Budget und Personal ausstatten. Von Denis Glismann –

Artikel lesen

Koalitionsvertrag Baden-Württemberg: Kameras sollen prüfen, wer und wie brav du bist

Grün-Schwarz will in Baden-Württemberg als erstem Bundesland doppelte KI-Videoüberwachung ausrollen: Kameras, die Menschen auf verdächtiges Verhalten überprüfen und sie gleichzeitig mit Gesichtserkennung analysieren. In Mannheim und zwei weiteren Städten soll das Pilotprojekt starten. Von Martin Schwarzbeck –

Artikel lesen

Du siehst aber jung aus: Meta will uns bis auf die Knochen überwachen

Auf der Suche nach Minderjährigen will Meta Nutzer*innen auf Facebook und Instagram umfassend durchleuchten. Der Konzern will sogar die Knochenstruktur von Menschen auf Fotos auswerten. Wie gefährlich ist das? Die Analyse. Von Sebastian Meineck –

Artikel lesen

Verfahren gegen Tech-Konzerne: EU-Kommission zögert, Abgeordnete verlieren Geduld

Wann setzt Europa seine Digitalgesetze gegen Tech-Konzerne durch? Die EU-Kommission knickt ein, fürchten Abgeordnete und Vertreter:innen der Zivilgesellschaft. Nun wollen sie Kommissionspräsidentin Ursula von der Leyen Beine machen. Von Tomas Rudl –

Artikel lesen

KI-Verordnung: EU-Parlament und Rat einigen sich auf gelockerte Pflichten für die Industrie

Die EU will die KI-Verordnung aufweichen. Eine erste Einigung sieht nun vor, bestimmte Regulierungen für die Industrie abzuschwächen und zeitlich deutlich nach hinten zu verschieben. Hinzugekommen ist ein Verbot von KI-Anwendungen, mit denen sexualisierte Deepfakes erstellt werden können. Von Denis Glismann, Chris Köver –

Artikel lesen

Digitales Bezahlen: „Die Leute haben sehr gute Gründe, Bargeld zu nutzen“

Digitale Zahlungen sind auch eine soziale Frage. Die Soziologin Barbara Brandl hat untersucht, wie digitale Zahlungen Ungleichheit verstärken. Im Interview erklärt sie, wie dabei von unten nach oben umverteilt wird und was uns Beispiele aus anderen Ländern für den Digitalen Euro lehren. Von Leonhard Pitz –

Artikel lesen

Widerstand gegen Überwachung: „Man kann Kameras auch kaputtmachen“

Verhaltensscanner, Gesichtserkennung, Datenanalyse: Immer mehr Bundesländer rüsten mit KI-Überwachung auf. Bislang lief das weitgehend geräuschlos. Jetzt regt sich Widerstand. Von Martin Schwarzbeck –

Artikel lesen

Attacke auf Messenger: Signal will in Zukunft stärker vor Phishing warnen

Signal reagiert auf die umfangreiche Phishing-Kampagne mit Änderungen in der App. Derweil wird die Dimension der Attacke deutlicher: Schon im Januar waren fast 14.000 Accounts gezielt angeschrieben worden. Von Markus Reuter –

Artikel lesen

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Signal reagiert auf die umfangreiche Phishing-Kampagne mit Änderungen in der App. Derweil wird die Dimension der Attacke deutlicher: Schon im Januar waren fast 14.000 Accounts gezielt angeschrieben worden.

In einem Interview mit dem Spiegel (€) hat Signal-Chefin Meredith Whittaker angekündigt, dass der Messenger in Zukunft zusätzliche Warnhinweise anzeigen wird, um Phishing besser zu verhindern. Hintergrund der Maßnahme sind die teilweise erfolgreichen Phishing-Versuche gegen Vertreter:innen aus Politik, Militär und Journalismus, der in Deutschland nach Medienberichten zwei Ministerinnen und die Bundestagspräsidentin zum Opfer fielen.

Im Interview sagte Whittaker:

Wenn jemand zum ersten Mal eine Nachricht von einer unbekannten Nummer erhält, werden künftig zusätzliche Warnhinweise angezeigt. Das Annehmen neuer, unbekannter Kontakte wird in Zukunft nicht mehr mit einem einzigen Klick möglich sein und zwingend einen Warnhinweis enthalten. Wir prüfen noch weitere Ideen und werden dazu bald mehr bekannt geben. Und um es noch einmal klar zu sagen: Signal wird Nutzer niemals in einem zweiseitigen Chat kontaktieren, um sie nach ihrer PIN, ihrem Schlüssel oder anderen Informationen zu fragen.

Öffentlich bekannt wurde die Attacke in Deutschland, als netzpolitik.org am 28. Januar darüber berichtete, dass zahlreiche Journalist:innen im Visier stünden. Gut eine Woche nach dem Bericht warnten dann der Verfassungsschutz (BfV) und das Bundesamt für Sicherheit in der Informationstechnik (BSI) vor der Angriffswelle. Mittlerweile haben die Behörden ein weiteres Update der Warnung samt Handlungsleitfaden veröffentlicht.

Am gestrigen Donnerstag war die Phishing-Kampagne auch Thema im Digital- und im Innenausschuss des Bundestages. In nicht-öffentlicher Sitzung wurde durch Verfassungsschutzchef Sinan Selen und BSI-Chefin Claudia Plattner die Kampagne nachgezeichnet und noch einmal vor Phishing gewarnt. Laut dem Bericht wussten die Behörden erst „im Januar“ über die Angriffe Bescheid. Nach Informationen von netzpolitik.org könnte allerdings ein Ende 2025 vom Phishing betroffener Bundestagsabgeordneter beide Behörden schon früher informiert haben.

Viel spricht für Russland als Urheber des Angriffs

Mittlerweile verdichtet sich, dass Russland hinter der Attacke stecken dürfte. Das niederländische Verteidigungsministerium hatte Anfang März verlautbart, dass Russland hinter der laufenden Phishing-Kampagne gegen hochrangige Personen aus Politik, Militär, Zivilgesellschaft und Journalismus stecken soll. BSI und Verfassungsschutz hatten vor den Attacken gewarnt und diese als „wahrscheinlich staatlich gesteuert“ bezeichnet. Die Bundesregierung schreibt den Angriff bislang nicht offiziell einem Land zu, ließ aber über Regierungskreise verbreiten, dass Russland dahinter stecke.

In einer Mitteilung auf der Webseite des niederländischen Verteidigungsministeriums sprechen sowohl der militärische Geheimdienst MIVD als auch der zivile Geheimdienst AIVD von „russischen Staatshackern“, die hinter dem Angriff auf Signal und WhatsApp stecken würden. Auch netzpolitik.org hat Hinweise, welche die Theorie einer russischen Urheberschaft des Angriffs untermauern.

Mehr als 13.700 Telefonnummern

Das Medienhaus Correctiv hatte zudem den Angriff auf den früheren Vizepräsidenten des Bundesnachrichtendienstes, Arndt Freytag von Loringhoven, ausgewertet und ist dabei auch auf digitale Spuren gestoßen, die nach Russland führen.

Weiteren Spuren nachgegangen sind auch die IT-Sicherheitsexperten des Security Labs von Amnesty International, die sich schon frühzeitig mit der Kampagne befasst haben. Sie haben einem Bericht des Spiegels (€) zufolge ein Angriffswerkzeug gefunden. Wie Donncha Ó Cearbhaill, der Leiter des Amnesty-Labs dem Medium mitteilte, soll es sich um ein in russischer Sprache programmiertes Werkzeug namens ApocalypseZ handeln.

Die Untersuchung konnte erstmals auch eine Zahl der angegriffenen Signal-Accounts offenlegen. In der Datenbank der Angreifer konnten die Amnesty-Expert:innen Mobilfunknummern potenzieller Opfer sehen. „Im Januar waren es mehr als 13.700“, sagte Ó Cearbhaill gegenüber dem Spiegel. In den Screenshots des Schadprogramms konnten die Forscher:innen zudem sehen, dass viele der Phishing-Nachrichten über polnische und niederländische Nummern verschickt wurden.

Laut dem Spiegel-Bericht bestätigt sich nun auch die Annahme, die Donncha Ó Cearbhaill schon im Januar gegenüber netzpolitik.org geäußert hatte: Die Angreifer lesen die Kontakte derjenigen aus, die auf das Phishing hereinfallen – und versenden dann neue Nachrichten. Ziel ist die Übernahme der Accounts samt Einblicken in Netzwerke und zukünftige Inhalte der Kommunikation.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Verhaltensscanner, Gesichtserkennung, Datenanalyse: Immer mehr Bundesländer rüsten mit KI-Überwachung auf. Bislang lief das weitgehend geräuschlos. Jetzt regt sich Widerstand.

Ende April, ein Platz im Görlitzer Park in Berlin: Etwa 100 Menschen stehen vor einer Bühne, am Rand eine Reihe Polizeifahrzeuge und Gruppen von Polizist*innen. Es gibt kostenloses Essen und Rap. Die Bühne haben Aktivist*innen mit Überwachungskameras dekoriert. Davor ist ein Banner gespannt, Aufschrift: „Gegen Überwachung und Ausgrenzung“. In kleinerer Schrift darunter: „Keine KI-Videoüberwachung unserer Parks, Plätze und Straßen!“

Diesen Park will die Polizei künftig mit Videokameras und Verhaltensscanner-Software kontrollieren, so wie weitere Orte in Berlin. Die Software, eine sogenannte Künstliche Intelligenz, soll analysieren, was die abgebildeten Menschen gerade tun und gutes von schlechtem Verhalten unterscheiden. Deshalb sind die Demonstrierenden hier. Sie lehnen die KI-Kontrolle ab. Die Person am Mikrofon ruft: „Man kann Kameras auch kaputt machen!“

Neun Bundesländer haben ihrer Polizei den Einsatz von Verhaltensscannern entweder bereits erlaubt – oder planen, dies zu tun. Bislang setzen Polizeien die Technologie nur in Mannheim und Hamburg ein. Doch die Zahl der Orte, die damit überwacht werden, wird sich wohl bald deutlich erhöhen.

Größere Polizeigesetz-Änderungen

Mehrere Bundesländer legalisieren derzeit Verhaltensscanner im Rahmen größerer Polizeigesetz-Reformen. Sie genehmigen den Beamt*innen unter anderem den Einsatz von Datenanalyse à la Palantir, Live-Gesichtserkennung oder Videodrohnen. In einigen Ländern, die gerade ihr Polizeigesetz verschärfen oder verschärft haben, formt sich auch außerparlamentarischer Widerstand.

Magdalena Finke, CDU-Innenministerin von Schleswig-Holstein hat mit ihrem Polizeigesetz-Entwurf Fans des Fußballvereins in Kiel gegen sich aufgebracht. Die mobilisieren in der Fanszene und vernetzen sich darüber hinaus mit zivilgesellschaftlichen Initiativen. „Das wurde komplett im Hinterzimmer ausgehandelt“, sagt Fußballfan Jan auf Anfrage von netzpolitik.org über das Polizeigesetz.

Jan und seine Mitstreiter*innen wollen eine große Demo durch die Landeshauptstadt Kiel organisieren. Kein bloßer Fanmarsch, sondern ein breites Bündnis. „Wir wollen Menschen aus dem ganzen Landesgebiet mobilisieren“, sagt Jan. Geplant sind außerdem Infoveranstaltungen für Fußballfans, Flyer und Aktionen mit Spruchbändern im Stadion. „Wir sehen das als unsere Aufgabe, das Polizeigesetz in unserer Kurve zum großen Thema zu machen.“

Das volle Programm High-Tech-Überwachung

Die schwarz-grüne Landesregierung von Schleswig-Holstein steht kurz davor, das volle Programm High-Tech-Überwachung genehmigt zu bekommen: Datenanalyse nach Palantir-Art, Verhaltensscanner, Live-Gesichtserkennung, Gesichtersuchmaschine. Am 6. Mai haben die Abgeordneten den Gesetzentwurf erstmals im Parlament besprochen.

Jan sagt: „Durch Überwachung und erst recht durch KI-Überwachung werden die Freiräume immer begrenzter. Freiräume sind aber ein wichtiger Teil der partizipativen Demokratie.“

Begründet werde die Ausweitung der Überwachung mit Messerangriffen. „Aber in Kiel gibt es kaum bis keine Messerangriffe. Dann kann man doch nicht deshalb der Polizei solche Befugnisse geben. Die lassen sich nicht wieder zurückdrehen“, sagt Jan. Er befürchtet, dass bald alle öffentlichen Plätze im Land KI-überwacht werden.

Wie wir bereits berichtet haben, gibt es auch in Thüringen Widerstand gegen das dortige Polizeigesetz. Der bekommt zunehmend Schwung, wie die Initiator*innen der Anti-Polizeigesetz-Kampagne ThürPAG stoppen berichten. Zu den Kritiker*innen gehören inzwischen die antifaschistischen Bündnisse Auf die Plätze Erfurt und Rechtsruck Stoppen, der Verein Vielfalt Leben – QueerWeg und der Hacker*innentreff Krautspace Jena.

Kunstaktionen gegen Überwachung

In Sachsen wehrt sich das antifaschistische Aktionsbündnis Leipzig nimmt Platz gegen die Polizeigesetz-Novelle. Die Dresdner Datenpunks planen Kunstaktionen zu Überwachung, um darüber mit Menschen ins Gespräch zu kommen.

Aufklärung zur niedersächsischen Polizeigesetznovelle leisten der Kleindatenverein und Freiheitsfoo.

Derweil agieren Initiativen wie Kameras stoppen aus Köln, Bündnis Hansaplatz aus Hamburg oder dieDatenschützer Rhein-Main seit Jahren nicht ohne Erfolg gegen Video- und KI-Überwachungs-Projekte – auch vor Gericht.

Ausdrücklich gegen die Massen-Datenanalyse positioniert sich das Bündnis Kein Palantir in Baden-Württemberg. Das Netzwerk Sicherheit ohne Überwachung macht derweil auf Bundesebene gegen verschärfte Gesetze mobil. Es geht einmal mehr um biometrische Gesichtersuche, um Datenanalyse nach Palantir-Art – und Vorratsdatenspeicherung. Unter anderem geplant ist eine Demonstration am 13. Juni 2026 ab 14 Uhr in Berlin.

Die Gewerkschaft der Osterhasen

Zurück zur Kundgebung im Görlitzer Park. Dahinter stehen drei Initiativen: Cables of Resistance, die in Berlin kürzlich einen Kongress zum Kampf gegen die Big-Tech-Übermacht veranstaltet hat; Wrangelkiez United, eine polizeikritische Anwohner*innengruppe – und Görli 24/7, die dagegen kämpft, dass die Stadt den Görlitzer Park inzwischen nachts verriegelt.

Für einen offen zugänglichen Görlitzer Park sind auch zwei Redner*innen, die als nächstes die Bühne betreten, maskiert mit rosa Hasenköpfen. Sie stellen sich als Vertreter*innen der „Osterhasen-Gewerkschaft“ vor und erzählen, dass Menschen bereits Nachschlüssel zu den Parktoren an Interessierte verteilt hätten. Einige Eingänge könne man auch selbst öffnen, wenn man eine Türklinke in die dafür vorgesehene Öffnung schiebt. „Klinken bekommt ihr am Info-Stand“, ruft einer der Hasen.

Bevor die Osterhasen die Bühne betreten, gibt es eine unfreiwillige Programm-Pause. Beamt*innen treten an die Bühne heran und wollen Personalien sehen – von der Person, die über kaputte Kameras gesprochen hatte. Gibt es jetzt Ärger?

Per Mikrofon hält eine andere Person aus dem Kreis der Veranstalter das Publikum auf dem Laufenden. Sie gibt weiter, dass die Polizei die Aussage über die Zerstörbarkeit von Kameras für eine Straftat hält. „Also sagt das nicht“, ruft sie durch die Lautsprecher. „Sagt nicht, dass man Kameras auch kaputtmachen kann.“

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Digitale Zahlungen sind auch eine soziale Frage. Die Soziologin Barbara Brandl hat untersucht, wie digitale Zahlungen Ungleichheit verstärken. Im Interview erklärt sie, wie dabei von unten nach oben umverteilt wird und was uns Beispiele aus anderen Ländern für den Digitalen Euro lehren.

Ob an der Eisdiele oder an der Kinokasse – immer weniger Menschen zahlen mit Bargeld. Viele zücken eine Plastikkarte oder gleich ihr Smartphone. Den Kostenanteil für den gemeinsamen Ausflug PayPal-en einem die Freund:innen sowieso lieber direkt auf der Rückfahrt.

Digitale Bezahlsysteme sind nicht nur längst Teil unseres Alltags, sondern auch Gegenstand politischer Debatten. Diese drehen sich – sofern sie den Dunstkreis technokratischer Diskurse verlassen – meist um Datenschutz oder Digitale Souveränität. Doch hinter den Apps und Karten versteckt sich auch eine soziale Frage.

Barbara Brandl ist Professorin für Soziologie an der Goethe-Universität in Frankfurt am Main, mit Schwerpunkt auf Wirtschafts- und Organisationssoziologie. Zudem ist sie Sprecherin des Forschungsprojektes „Die normativen Dimensionen des Digitalen Euro“. Wir haben mit ihr über soziale Ungleichheit, digitalisierte Zahlungen und Lektionen für den Digitalen Euro gesprochen.

netzpolitik.org: Frau Brandl, Sie sind Soziologin. Warum beschäftigen Sie sich mit PayPal und Kreditkarten?

Barbara Brandl: Ich beschäftige mich immer mit dem Zwischenfeld von Technologieentwicklung und Gesellschaft und bin eigentlich über das Thema Blockchain zum Thema Zahlungen gekommen. Ich habe aber festgestellt, dass Blockchain für den Alltag der meisten Menschen keine allzu große Bedeutung hat. Was hingegen eine große Bedeutung hat, sind alle Systeme, über die wir digital bezahlen.

Wir alle müssen zahlen: Um zu überleben, weil wir eben nicht alles selber herstellen und mit Nachbarn tauschen, sondern weil der absolut größte Teil über formale Märkte funktioniert. In meiner Forschung habe ich dann festgestellt, dass digitale Zahlungen und soziale Ungleichheit sehr stark miteinander zusammenhängen. Und das ist natürlich das Kernthema der Soziologie.

Die drei Wellen der Zahlungsdigitalisierung

netzpolitik.org: Was sind überhaupt digitale Bezahlsysteme? Nur PayPal und GooglePay?

Barbara Brandl: „Digitale Bezahlsysteme“ umfasst erst einmal alles, was nicht Bargeld ist. Insgesamt gab es drei Wellen der Digitalisierung von Zahlungen im Globalen Norden. Die erste Welle der digitalen Zahlungen begann etwa 1950 mit den Kreditkarten in den USA. Das war lange auch das einzige vorhandene System. Die zweite Welle digitaler Zahlungen begann in den 1990er-Jahren umfasst alles, was Internet-basiert ist, auch PayPal war da ganz wichtig. Die dritte Welle sind für mich App-basierte-Lösungen, die sich mit der Nutzung von Smartphones in den 2010er-Jahren ausbreiteten. Beispiele dafür sind etwa Apple oder GooglePay aber auch „Buy Now, Pay Later“-Angebote wie Klarna.

netzpolitik.org: Das gilt aber nur für den Globalen Norden, wie ist das im Globalen Süden?

Barbara Brandl: Dort haben sich eigene Systeme digitaler Zahlungen herausgebildet, deren Entwicklungen sich mit denen im Globalen Norden überschneiden. Das erste und vielleicht spannendste ist das sogenannte „Mobile Money“. Der Hintergrund war, dass in Subsahara-Afrika der Großteil der Menschen überhaupt keinen Zugang zu Bankkonten hatte. Und auch Bankfilialen waren in den Flächen quasi nicht vorhanden. Das war sehr ungünstig, denn viele Menschen waren darauf angewiesen, regelmäßig Geld zu versenden, zum Beispiel, weil jemand in der Stadt gearbeitet hat, aber die eigene Familie auf dem Land versorgen wollte. Oder weil die eigenen Kinder im Internat waren und Bücher brauchten.

In den 90er Jahren kam dann der Mobilfunk auf und das ist die Revolution. In ihrer Verzweiflung erfanden die Menschen Geld neu und verschicken über SMS die Codes, die auf den PrePaid-Karten aufgedruckt waren. Die haben das also nicht mehr nur als Mobilfunkguthaben benutzt, sondern als Geld. Und dann gab es relativ schnell Leute, die das informell gewechselt haben, Mobilfunkguthaben in Bargeld und umgekehrt. Diese Dienste wurden dann rasch kommerzialisiert von den Mobilfunkanbietern und das war die erste Form einer digitalen Währung.

netzpolitik.org: Was sind die anderen Systeme digitaler Zahlungen im Globalen Süden?

Barbara Brandl: Einerseits Super-Apps wie Alipay oder Tencent, die in China entstehen und sich dann in Ostasien sowie teilwiese auch in Lateinamerika ausbreiten. Und anderseits Echtzeitzahlungssysteme wie das brasilianische PIX, die von Zentralbanken bereitgestellt werden und insbesondere in Lateinamerika populär sind, aber jüngst auch in Ländern wie Indien oder Israel eingerichtet wurden.

„Technologie ist nicht neutral“

netzpolitik.org: Sie forschen dazu, inwiefern digitale Bezahlmöglichkeiten soziale Ungleichheit verändern – was haben Sie herausgefunden?

Barbara Brandl: Technologie ist nicht neutral, auch nicht die Systeme digitaler Zahlung. Sie wurden von bestimmten Schichten mit bestimmen Ideen eingerichtet. Am krassesten sieht man das bei den Kreditkarten in den Vereinigten Staaten. Die wurden eingerichtet, damit die Mittelschichten schnellen Zugang zu Krediten bekommen und einfach bezahlen können. Das waren vor allem die weißen Mittelschichten und die profitieren bis heute am stärksten von den Kreditkarten.

Alles netzpolitisch Relevante

Drei Mal pro Woche als Newsletter in deiner Inbox.

Es gibt verschiedene Dimensionen sozialer Ungleichheit. Eine davon ist Zugang. Weiße haben sehr viel häufiger Kreditkarten als Schwarze oder Hispanics. Die Mittelschicht hat viel häufiger Kreditkarten als die Unterschicht. Man kann hier schon von Ausschluss sprechen. Das war bis in die 1990er-Jahre noch brutaler, dort haben Menschen gar keine Kreditkarte bekommen, wenn sie in bestimmten Vierteln gewohnt haben. Seither wurde der Zugang extrem ausgeweitet, man spricht auch von einer Demokratisierung der Kreditvergabe. Trotz allem haben Hispanics und Schwarze bis heute bei gleichen Einkommensverhältnissen seltener Kreditkarten als weiße US-Bürger.

Hinzu kommt die zweite Dimension: die systematische Benachteiligung in der Nutzung. Das funktioniert zum Beispiel durch massive Kreditkartenzinsen auf „Bad Credit“, also wenn sie mit einer schlechten Bonität einen Kredit aufnehmen. Der Zins kann schon mal 30 Prozent betragen. Alle Schichten haben Kreditkartenschulden. Aber Menschen aus mittleren und oberen Schichten können diese Schulden mit einem guten Gehalt relativ schnell zurückzahlen. Aber die einkommensärmsten zehn Prozent der Bevölkerung müssen, sofern sie Kreditkartenschulden haben, durchschnittlich 80 Prozent ihres Einkommens für die Tilgung dieser Schulden aufwenden.

netzpolitik.org: Wie werden ärmere Menschen noch systematisch benachteiligt?

Barbara Brandl: Ein weiterer Faktor bei der Umverteilung von arm zu reich sind sogenannte „Loyality“- beziehungsweise Cashback-Programme. Das funktioniert so: Immer wenn sie mit ihrer Kreditkarte im Supermarkt zahlen, kriegen sie Punkte. Die reichen sie am Ende des Jahres ein und kriegen Geld zurück. Allerdings ist die Kreditkarte das teuerste Zahlungsmittel für die Händler:innen. Die schlagen das wiederum bei den Preisen drauf. In der untersten Schicht – in den USA – haben nur 30 Prozent der Menschen eine Kreditkarte. Die zahlen aber trotzdem natürlich alle die höheren Preise und subventionieren damit die höheren Preise für Güter sowie die Prämien quer, die den höheren Schichten ausgezahlt werden.

Ökonomen der US-amerikanischen Zentralbank haben ausgerechnet, dass alleine dieser Mechanismus über zwölf Milliarden Euro im Jahr umverteilt, von schlechter Bonität zu guter Bonität, also in der Regel von Menschen mit geringer Bildung zu Menschen mit höherer Bildung. Höhere Schichten profitieren von Kreditkarten und niedrigere Schichten tragen die Kosten.

„Der größte Teil der Gewinne kommt von Überziehungszinsen“

netzpolitik.org: Wie meinen Sie das?

Barbara Brandl: Der größte Teil der Gewinne von Kreditkartenfirmen – und generell innerhalb dieses Sektors – kommt durch Überziehungszinsen. Transaktionsgebühren, die bei jeder Zahlung anfallen, sind zwar die älteste Einnahmequelle, bringen aber nicht so viel Gewinn ein. Die modernste Einnahmequelle ist der Verkauf von Daten. Das machen etwa die Super-Apps in Asien. Aber auch Buy-Now-Pay-Later-Anbieter im Globalen Norden, wie PayPal, Klarna und AfterPay, verkaufen Daten für Werbezwecke. Dennoch sind die Zinsen auf Konsumkreditschulden immer noch die finanzstärkste Einnahmequelle.

netzpolitik.org: Am Ende nehmen die Menschen einen Kredit ja freiwillig auf. Sind sie dann nicht auch ein Stück weit selbst verantwortlich, wenn sie sich überschulden?

Barbara Brandl: Das ist genau der Punkt, wie das in unserer Gesellschaft moralisch funktioniert und warum hier nicht mehr reguliert wird. Eine sehr bekannte Kollegin von mir, Greta Krippner, argumentiert dazu wie folgt: Wir haben in der Gesellschaft immer asymmetrische Beziehungen. Eine ganz klassische asymmetrische Beziehung ist die zwischen Arbeitgeber und Arbeitnehmer und die regulieren wir sehr stark und es gibt starke Schutzmechanismen für Arbeitnehmer, wie etwa Kündigungsschutz für Schwangere.

Diese Schutzmechanismen fehlen in der Beziehung Kreditnehmer versus Kreditgeber, obwohl diese Beziehung ebenfalls hoch-asymmetrisch ist. Und diese Schutzlosigkeit ist bei Konsumkrediten am stärksten.

Aber es gibt noch eine weitere Ebene und da sehe ich eine Parallele zur Debatte um die Regulierung von Social-Media-Plattformen.

Geschäftspraktiken, die menschliche Schwächen ausnutzen

netzpolitik.org: Worin besteht diese Parallele?

Barbara Brandl: Es geht um Geschäftspraktiken, die systematisch menschliche Schwächen ausnutzen. Dazu gibt es ein ganzes Forschungsfeld, die sogenannten Behavioral Economics. Daraus wissen wir: Unser Gehirn funktioniert auf eine bestimmte Art und Weise und bestimmte Dinge können wir nicht gut verarbeiten, zum Beispiel Kosten und Nutzen von Kreditkarten.

Es gibt eine ganze Reihe von Studien, die sagen: Wir unterschätzen systematisch, wie viel uns Kreditkarten kosten und überschätzen den Nutzen. Wir kommen darauf, wenn wir länger nachdenken, aber so auf die Schnelle passieren systematische Fehleinschätzungen. Und diese systematischen Verzerrungen werden eben ausgenutzt. Dann ist es nun mal zynisch, immer zu schreien, dass wir mehr Finanzbildung und den mündigen Konsumenten bräuchten. Ebenso wie in der Plattform-Debatte derzeit oft nach Medienbildung gerufen und gefordert wird, die Eltern sollten sich jetzt mal bitte besser um ihre Kinder kümmern.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

netzpolitik.org: Wir haben bisher viel über Kredite gesprochen, aber haben das Interview eigentlich bei digitalen Zahlungen angefangen. Das sind ja erst mal zwei verschiedene Dinge. Für Sie gehört aber beides zusammen, korrekt?

Barbara Brandl: Richtig, das ist ein zentraler Befund meiner Forschung. Ich habe mir fünf Systeme angeschaut, wie digitale Zahlungen abgewickelt werden. Was mich erschreckt hat: Je mehr digitale Zahlungen getätigt werden, desto stärker spielen Konsumkredite eine Rolle.

Das krasseste Beispiel ist vielleicht das Zahlungssystem PIX in Brasilien. PIX wird von der brasilianischen Zentralbank zur Verfügung gestellt und man sieht, für ein Prozent mehr PIX-Nutzer:innen erhöht sich die Menge der Konsumkredite um 0,8 Prozent. Das war das Ergebnis einer multivariaten Analyse. Das heißt, je mehr Leute, und das wissen wir auch aus anderen Studien, digital bezahlen, desto mehr geben sie aus und deswegen verschulden sie sich auch schneller.

Die Mechanismen dahinter sind ausführlich von den Verhaltensökonom:innen beschrieben worden. Ein Beispiel für diese Mechanismen ist: Sie gehen beispielsweise in die Stadt und wollen sich einen Mantel kaufen. Dann nehmen Sie, je nachdem wie Ihr Budget ist, 100 oder 200 Euro mit und vielleicht noch 20 Euro extra. Wenn das ausgegeben ist, können Sie nicht mehr kaufen. Wenn Sie aber digital bezahlen, haben Sie ihr ganzes Geld ja immer dabei. Dann können Sie sich auch einen Mantel kaufen, der doppelt so teuer ist wie ihr Budget – oder noch einen Gürtel extra.

„Gut für die Finanzindustrie, aber nicht für uns“

netzpolitik.org: Wo sind da die Parallelen zum digitalen Euro?

Barbara Brandl: Die brasilianischen Banken setzen auf die PIX-Bezahlfunktion ihre eigenen Kreditprodukte drauf und nennen es dann PIX Parcellado, also Ratenzahlung. Das heißt, sie bezahlen es mit PIX und PIX wird immer über die App der Bank benutzt und dann bietet Ihnen die Bank in der App sofort einen Kredit an, sofort eine Ratenzahlung an. Und da liegt die Parallele zum digitalen Euro.

Weil der viel Gegenwind aus der Finanzlobby bekommt, wirbt nun die Europäische Zentralbank mit dem Argument, dass die Banken ihre eigenen Finanzdienstleistungen auf den digitalen Euro draufbauen können. Und aus der brasilianischen Erfahrung würde ich sagen, das können wir eigentlich gar nicht wollen. Die EZB versucht, die Finanzindustrie mit dem Argument „Das ist doch gut für euch“ zu überzeugen. Ich würde sagen, das stimmt: Es ist auch für die Finanzindustrie gut, aber nicht für uns.

netzpolitik.org: Wie muss ein digitaler Euro aus Ihrer Sicht ausgestaltet sein, dass er möglichst sozial gerecht wird?

Barbara Brandl: Die Verknüpfung zu anderen Dienstleistungen, insbesondere der Aufnahme von Konsumkrediten, muss maximal weit weg davon sein. Das hat in Kenia nicht gut geklappt, aber in anderen Mobile-Money-Systemen in Subsahara-Afrika hat es besser funktioniert, dass man damit nur bezahlen kann.

Natürlich ist auch der Zugang ein Thema. In der Europäischen Union haben 96 Prozent der Menschen ein Konto. Und neben dem Basiskonto gibt es auch im Entwurf der Kommission zum Digitalen Euro schon Vorschläge, um Menschen ohne Konto zu integrieren. Das viel größere Problem ist hier ein anderes, nämlich dass ein Sechstel der Menschen zwar Konten hat, aber nicht in der Lage ist, Online-Banking zu nutzen. Leider wird das in der Diskussion oft so dargestellt, als seien die einfach ein bisschen altmodisch.

Ich würde mittlerweile aber sagen: Die nutzen zurecht Bargeld. Erstens behandeln die Banken Menschen aus einkommensschwächeren Schichten systematisch schlechter, das sehen wir überall auf der Welt. Deswegen ist das Misstrauen gegenüber Banken durchaus gerechtfertigt. Zweitens hat das natürlich auch was mit den Lebensumständen zu tun. Sie und ich sitzen den ganzen Tag am PC, da können wir das Online-Banking auch noch nebenbei machen. Wer auf dem Bau arbeitet, für den ist das ein sehr viel größerer Aufwand, sich da am Feierabend für das Online-Banking noch einmal hinzusetzen. Und dann ist es für Menschen mit geringem Einkommen viel einfacher, die eigenen Ausgaben mit Bargeld zu kalkulieren.

Ich würde trotzdem sagen, es gibt letztlich wahrscheinlich keine Alternative zum Digitalen Euro. Das ist immer noch die beste Lösung, die es gibt, wenn wir weiterhin digital bezahlen wollen und dabei nicht auf ein US-amerikanisches Oligopol von Kreditkartenfirmen angewiesen sein wollen, das den Großteil seiner Gewinne mit Überziehungszinsen und dem Verkauf von Daten macht.

netzpolitik.org: Also Ja zum Digitalen Euro, aber Bargeld auf jeden Fall erhalten?

Barbara Brandl: Das Bargeld erhalten will ja auch die EZB, nach eigener Aussage. Mein Appell ist sehr viel stärker, den Hang zum Bargeld nicht abzutun als irgendeine Schrulligkeit oder eine Verschrobenheit: Die Leute haben wirklich sehr gute Gründe, Bargeld zu nutzen.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die EU will die KI-Verordnung aufweichen. Eine erste Einigung sieht nun vor, bestimmte Regulierungen für die Industrie abzuschwächen und zeitlich deutlich nach hinten zu verschieben. Hinzugekommen ist ein Verbot von KI-Anwendungen, mit denen sexualisierte Deepfakes erstellt werden können.

Nachdem die EU-Verhandlungen zum digitalen Omnibus Ende April 2026 vorübergehend geplatzt waren, konnten Rat und Parlament gestern Nacht im Trilog eine vorläufige Einigung erzielen; die Kommission war als Vermittlerin beteiligt.

Die Einigung betrifft die Aufnahme des Verbots von sogenannten KI-Nudifiern in die KI-Verordnung. „Nudifier“ sind Anwendungen, mit deren Hilfe sexualisierte Deepfakes erstellt werden können. Außerdem sollen Auflagen für die Industrie beim Einsatz von risikoreichen KI-Systemen begrenzt sowie zentrale Pflichten aus dem AI Act für Hochrisiko-Systeme deutlich nach hinten verschoben werden – auf Ende 2027 und 2028. Der vorliegende Kompromiss zwischen Rat und Parlament muss noch formal bestätigt werden.

Der Trilog war zuvor an der Frage gescheitert, wie in der Industrie mit der Hochrisiko-Kategorie für KI-Systeme umgegangen werden soll, die bereits durch sektorale Bestimmungen reguliert werden. Zentrale Pflichten des AI Acts für besonders risikoreiche KI-Systeme sollten eigentlich bereits ab dem 2. August 2026 wirksam werden. Der Kompromiss sieht nun vor, dass die Anwendung der KI-Verordnung dort begrenzt wird, wo sektorale Sicherheitsanforderungen vergleichbare KI-Regeln enthalten.

Die EU verabschiedete den AI Act (Verordnung über künstliche Intelligenz) im Mai 2024. Er ordnet KI-Technologie vier abgestuften Risikokategorien zu und regelt Pflichten für die Hersteller und Anbieter von KI-Systemen oder Produkten, die KI-Technologie enthalten. KI-Systeme mit inakzeptablem Risiko können verboten werden.

Die EU-Kommission möchte die Regelungen im Rahmen des sogenannten Digitalen Omnibus jedoch vereinfachen, um bürokratische Hürden für Unternehmen abzubauen und Europas Wettbewerbsfähigkeit zu steigern. Das Gesetzespaket ist umstritten. Es enthält unter anderem Lockerungen bei der Datenschutzgrundverordnung oder beim Training von KI mit personenbezogenen Daten.

Verbot von KI-„Nudifiern“

Konkret haben sich Parlament und Rat darauf geeinigt, in Zukunft KI-Anwendungen zu verbieten, mit deren Hilfe man sexualisierte Deepfakes erstellen kann. Das Thema wurde zu einem zentralen Vorhaben, nachdem Nutzer*innen mit dem Chatbot Grok Anfang des Jahres binnen weniger Tage Millionen von nicht-einvernehmlichen Deepfakes erstellt hatten.

Bereits Ende März hatte sich das Parlament dafür ausgesprochen, solche KI-Anwendungen zu verbieten. Im Trilog ging es noch um die Details der Formulierung. Das Verbot umfasst jetzt explizit auch das Erstellen von Inhalten, die sexuellen Missbrauch von Kindern zeigen. Zudem soll es untersagt sein, KI-Anwendungen auf den Markt zu bringen, die ohne Zustimmung Deepfakes von “intimen Teilen einer identifizierbaren Person” oder die Person bei sexuellen Handlungen zeigen.

Die geplante Verschärfung ist nicht die erste EU-Regelung zu Deepfakes. Eine andere Richtlinie sieht bereits vor, dass Mitgliedstaaten die Verbreitung von sexualisierten Deepfakes unter Strafe stellen, wenn diese geeignet sind, einer Person schweren Schaden zuzufügen. Deutschland setzt dies mit dem geplanten Gesetz gegen digitale Gewalt derzeit um. Das geplante Verbot in der KI-Verordnung würde den Fokus von der Bestrafung der Täter*innen auf die Anbieter solcher Anwendungen verschieben.

Im geplanten Text steht nun auch die fehlende Zustimmung der gezeigten Personen als definierendes Merkmal. Fachleute forderten das seit langem. Zugleich kritisiert etwa Ana Ornelas von der European Sex Workers’ Rights Alliance (ESWA), die Beschränkung auf „identifizierbare Personen“. Sie fürchtet, dass dies in der Durchsetzung zu Schlupflöchern führen könnte.

Lockerungen und Fristverlängerung für Industrie

Hochrisiko-KI-Systeme in Bereichen wie Beschäftigung, Bildung, Migration, Strafverfolgung oder kritische Infrastruktur sollen Anforderungen aus dem AI Act erst ab dem 2. Dezember 2027 erfüllen müssen. Für KI in Medizinprodukten, Maschinen oder Spielzeug gilt der 2. August 2028. Anbieter von KI-Systemen müssen diese grundsätzlich in der EU-Datenbank für risikoreiche Systeme registrieren – auch wenn sie der Ansicht sind, die Einstufung als risikoreich träfe nicht zu oder sei ausgenommen.

Die Sonderregelung für Maschinenverordnung schwächt nach Meinung des europäischen Verbraucherverbands BEUC den Verbraucherschutz. Konkret kritisiert der Verband, dass Alltagsgeräte wie Industriemaschinen aus der KI-Aufsicht herausfallen würden. Bei deren Versagen könnten Menschen zu Schaden kommen. Der Deal enthält offenbar auch eine Klausel, mit der die EU-Kommission später weitere KI-Systeme ohne neues Gesetzgebungsverfahren aus dem Geltungsbereich des AI Acts herausnehmen kann. Die Kommission erhalte damit eine Hintertür für künftige KI-Deregulierung.

BEUC-Generaldirektor Agustín Reyna meint, der überhastete Prozess habe ein Gesetz hervorgebracht, das komplizierter und weniger wirksam als vorher sei und vor allem der Industrie nutze.

Zumindest an manchen Stellen scheint der Kompromiss strenger. Die EU-Kommission wollte die Verarbeitung sensibler personenbezogener Daten – etwa Angaben, aus denen Ethnie oder Religion hervorgehen können – zur Bias-Erkennung erleichtern. Rat und Parlament begrenzten hier durch striktere Maßstäbe.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Wann setzt Europa seine Digitalgesetze gegen Tech-Konzerne durch? Die EU-Kommission knickt ein, fürchten Abgeordnete und Vertreter:innen der Zivilgesellschaft. Nun wollen sie Kommissionspräsidentin Ursula von der Leyen Beine machen.

Der Druck steigt auf die EU-Kommission, europäische Digitalgesetze konsequent durchzusetzen. In einem offenen Brief fordern dutzende zivilgesellschaftliche Organisationen EU-Kommissionspräsidentin Ursula von der Leyen (CDU) auf, den Digital Markets Act (DMA) „buchstabengetreu und frei von politischer Einflussnahme“ zu vollstrecken.

Ähnliche Töne kommen aus dem EU-Parlament. Externer Druck dürfe die Souveränität und Autonomie der EU bei der Festlegung ihrer eigenen Regeln nicht beeinträchtigen, mahnen die Abgeordneten in einer vergangene Woche verabschiedeten Resolution. Wirksame und verhältnismäßige Geldstrafen seien „unerlässlich, um Abschreckung zu gewährleisten und die Wirksamkeit des Gesetzes über digitale Märkte zu sichern“, so der Tenor der nicht bindenden Entschließung.

Hintergrund für die Appelle sind vermehrte Zeichen, dass die EU-Kommission Beißhemmungen gegenüber großen, vor allem in den USA ansässigen Tech-Unternehmen hat – genau die Unternehmen, deren Macht der DMA eigentlich einhegen soll. Das seit wenigen Jahren wirksame Gesetz macht sogenannten Gatekeepern, die in bestimmen Digitalsektoren übermäßig viel Marktmacht angesammelt haben, eine Reihe an Auflagen, um einen funktionierenden Wettbewerb sicherzustellen.

Ergebnis im Google-Verfahren überfällig

Zwar hat die EU-Kommission, die für die Aufsicht der Gatekeeper zuständig ist, zahlreiche Untersuchungen wegen Verdachts von DMA-Verletzungen eingeleitet. Vor über einem Jahr hatte sie etwa Google und Apple vorgeworfen, ihre App-Marktplätze nicht ausreichend zu öffnen. Zum anderen sollte Google in der Suchmaschine eigene Angebote für Shopping oder Reisen bevorzugt haben.

Auf das Ergebnis dieser Untersuchungen wartet die Öffentlichkeit jedoch weiterhin. Fällig wäre es Ende März gewesen. Darauf scheint sich Alphabet vorbereitet zu haben: Anonyme Quellen hatten der Nachrichtenagentur Reuters zufolge zu Beginn des Jahres in Aussicht gestellt, dass Google seine Wettbewerber prominenter in den Suchergebnissen anzeigen werde, um der drohenden Geldstrafe zu entgehen. Umgesetzt hat Google das nicht.

Von der Leyen soll auf der Bremse stehen

Tatsächlich soll die EU-Wettbewerbsabteilung zu dem Schluss gekommen sein, dass Alphabet gegen den DMA verstoßen habe, berichtete jüngst das Handelsblatt (€). Die Entscheidung – samt einer milliardenschweren Geldbuße – soll jedoch nach einer Intervention von Ursula von der Leyen wieder in der Schublade verschwunden sein.

Dem Fachblatt The Capitol Forum (€) zufolge soll die Kommissionspräsidentin bereits seit Januar auf der Bremse stehen. Anstelle einer Verurteilung setzte die Kommission seit Jahresanfang weitere Verfahren in die Welt: Unter anderem will sie Alphabet dabei unterstützen, das Android-Betriebssystem für Entwickler:innen weiter zu öffnen sowie Dritt-Anbietern den Zugriff auf bestimmte Daten der Google-Suchmaschine zu geben.

Auf Anfrage bestreitet die EU-Kommission die Vorwürfe. „Es gibt absolut keine politische Blockade von Fällen“, sagte heute ein Kommissionssprecher bei einem Presse-Briefing. Abgeschlossene Untersuchungen seien auch in ihrem Interesse. Es gehe nicht darum, eine Strafe nur der Strafe wegen zu verhängen. Eine Entscheidung werde von der Kommission erst dann final abgesegnet, wenn sie „technisch fertig und solide genug“ sei, so der Sprecher.

Europäische Digitalgesetze, neben dem DMA auch der Digital Services Act (DSA) oder die Datenschutz-Grundverordnung (DSGVO), sind für große Tech-Konzerne wie Alphabet oder Apple ein rotes Tuch. Jahrzehntelang konnten sie weitgehend ungehindert wachsen und bestimmte Marktsegmente besetzen, ohne auf nennenswerten Widerstand von Kartellbehörden zu stoßen. Vor allem der in der ersten Amtsperiode von der Leyens verabschiedete DMA hat das wachsende Ungleichgewicht auf digitalen Märkten im Visier.

Mit dem Wahlsieg Donald Trumps und seiner America-First-Agenda hat die Tech-Branche einen willigen Unterstützer in ihrem Kampf gegen angebliche Überregulierung gefunden. Unmittelbar nach seinem Amtsantritt im Januar 2025 legte der US-Präsident etwa in einem Memorandum mit Verweis auf DMA und DSA fest, US-amerikanische Unternehmen vor „Erpressung und unfairen Geldbußen aus dem Ausland“ schützen zu wollen.

Gedroht hatte Trump unter anderem mit Strafzöllen, die er einige Monate später tatsächlich vorstellte. Zwar konnte sich die EU im Spätsommer auf einen Deal mit den USA einigen, ohne auf dem Papier die Digitalgesetze anzufassen. Vom Tisch ist die Auseinandersetzung jedoch nicht: Bis heute haben sich die EU-Institutionen nicht darauf geeinigt, wie die Zollvereinbarung aus dem Vorjahr umgesetzt werden soll.

„Die EU-Kommission knickt ein“

Auch für die US-Seite ist die Angelegenheit nicht abgeschlossen. Hochrangige US-Vertreter schießen weiterhin gegen EU-Digitalgesetze und verknüpfen sie mit dem Handelsstreit. Die EU müsse ihre Regulierung von Big Tech lockern, um im Gegenzug geringere Zölle auf Stahl und Aluminium entrichten zu müssen, sagte US-Handelsminister Howard Lutnick im Herbst. Zugleich warnte der US-Botschafter bei der EU, Andrew Puzder, dass der DMA zu sehr auf US-amerikanische Tech-Konzerne ziele.

Im April war bekannt geworden, dass die EU-Kommission ein Gremium plant, um der Trump-Regierung entgegenzukommen. Darin soll sich die US-Regierung mit der EU zu Digitalregeln und Kartellverfahren abstimmen, wie die EU-Kommission dem Handelsblatt bestätigte.

Das nachgiebige und intransparente Vorgehen der EU-Kommission stößt jedoch immer mehr auf Kritik. Felix Duffy von der Nichtregierungsorganisation LobbyControl sagt etwa: „Die EU-Kommission knickt ein und sendet ein fatales Signal: Wenn Tech-Konzerne bei Verstößen gegen die EU-Digitalregeln keine Konsequenzen zu fürchten haben, bleiben Gesetze wie der DMA wirkungslos.“

Dem pflichtet Max Bank von der Organisation Rebalance Now bei: Zwar zeige der DMA Wirkung, drohe aber zum zahnlosen Tiger zu werden, weil die Kommission nicht konsequent handle. „Wenn selbst überfällige Strafzahlungen gegen Konzerne wie Google politisch gestoppt werden, untergräbt das die Glaubwürdigkeit des Gesetzes“, sagt Bank.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Auf der Suche nach Minderjährigen will Meta Nutzer*innen auf Facebook und Instagram umfassend durchleuchten. Der Konzern will sogar die Knochenstruktur von Menschen auf Fotos auswerten. Wie gefährlich ist das? Die Analyse.

Instagram und Facebook wollen ihre Nutzer*innen künftig noch genauer unter die Lupe nehmen. Eine als KI bezeichnete Software soll unter anderem Texte in Posts und Kurzbios kontrollieren und Objekte in Fotos und Videos scannen. Die Software soll sogar die Körpergröße und Knochenstruktur abgebildeter Personen auswerten. Das Ziel dieser Art von Rasterfahndung sind Minderjährige.

Schätzt die Software eine Person für verdächtig jung ein, soll sie ihr Alter nachweisen. Junge Menschen unter 18 Jahre sollen die Plattformen nur im Jugendschutz-Modus nutzen; Kinder unter 13 Jahre dürfen keinen Account haben.

Wer also künftig auf Instagram Fotos vom Kindergeburtstag postet oder über Schulnoten spricht, könnte Probleme bekommen. Die Software könnte das als Hinweis werten, dass man noch nicht erwachsen ist. Diese beiden Beispiele kommen aus der Pressemitteilung von Meta.

Die neue KI-Überwachung startet Instagram demnach jetzt in der EU und in Brasilien. Zuvor lief sie bereits in den USA, Australien, Kanada und dem Vereinigten Königreich. Auf Facebook rollt Meta die Überwachung zunächst in den USA aus; im Juni soll sie für EU und Vereinigtes Königreich folgen.

Hier kommen die fünf wichtigsten Fragen und Antworten zu Metas neuen Alterskontrollen.

- 1. Bergen Metas Alterskontrollen Gefahren?

- 2. Warum macht Meta das?

- 3. Ist das neu?

- 4. Darf Meta das?

- 5. Was passiert als nächstes?

1. Bergen Metas Alterskontrollen Gefahren?

Ein Fachbegriff für die von Meta geplanten Alterskontrollen ist Inferenz, einfacher ausgedrückt: schlussfolgern. Inferenz-Methoden kombinieren mehrere Anhaltspunkte, um das Alter einer Person zu schätzen. Dabei können Dinge schiefgehen – besonders wenn ein Tech-Konzern sogar Fotos und Videos mit sogenannter KI durchsuchen will.

- Datenmaximierung: In der EU verankert die Datenschutz-Grundverordnung (DSGVO) den Grundsatz der Datenminimierung. Das heißt im Fall von Meta: Der Konzern soll nicht mehr Daten sammeln und verarbeiten als nötig. Auf Datenminimierung pocht auch die EU-Kommission in ihren Leitlinien, die beschreiben, wie Online-Dienste Minderjährige schützen sollen; Grundlage is das Gesetzes über digitale Dienste (DSA). Passend dazu fordern in der aktuellen Debatte um Altersgrenzen und Social-Media-Verbote Politiker*innen durch die Bank weg, Alterskontrollen sollen datensparsam ein. Was Meta plant, ist jedoch das Gegenteil: Der Konzern will Daten nicht minimieren, sondern maximieren. Er will „mit KI-Technologie komplette Profile analysieren“.

- Kontrollverlust: Meta listet nicht vollständig auf, was die Software auf der Suche nach Minderjährigen alles einbezieht. Hinweise auf Geburtstage oder Schulnoten sind nur Beispiele; ebenso die Knochenstruktur von Menschen in Fotos und Videos. Nutzer*innen können deshalb nicht wissen, welche der Dinge, die sie posten, möglicherweise problematisch sein könnten. Sie wissen auch nicht, was genau mit den aus der Analyse gewonnenen Erkenntnissen passiert. Meta ist ein Datenschlucker; in der Vergangenheit hatte der Konzern mehrfach Datenschutz-Skandale. Die autoritäre US-Regierung hat potenziell Zugriff auf Daten von Meta-Nutzer*innen in der EU. Daraus folgt: Menschen auf Instagram und Facebook können kaum kontrollieren, was mit ihren Daten geschieht.

- Fehleinschätzungen: Inferenz-Methoden setzen auf Hinweise, aber Hinweise sind keine Fakten. Die Software könnte Menschen zu Unrecht als minderjährig einstufen. In der Folge müssten sie potenziell invasive Alterskontrollen überwinden; etwa auf Basis von Ausweisen oder biometrischen Gesichtsscans. Eventuell geraten manche Gruppen besonders oft in Verdacht, noch nicht erwachsen zu sein. Etwa Menschen, die sich aufgrund von Sprachschwierigkeiten nur sehr einfach ausdrücken. Oder eher kleine, schmale Menschen, deren Körper eine Software als jugendlich einstufen würde.

- Gesellschaftsbild: Die Maßnahme steht für einen radikalen gesellschaftlichen Wandel im Umgang mit Risiken. Auf der Suche nach Minderjährigen werden praktisch alle Nutzer*innen zu Verdächtigen – und all ihre Uploads zu potenziellem Beweismaterial. Die Überwachung wichtiger Schauplätze der digitalen Öffentlichkeit wird zunehmend lückenlos. Lange Zeit wurden KI-gestützte Überwachungsmethoden vor allem diskutiert, um schwere Verbrechen aufzuklären. Jetzt sollen sie sogar Kinder aufspüren. Es geht um junge Menschen, die neugierig sind und Regeln brechen, nicht um Schwerverbrecher*innen. Das normalisiert permanente Überwachung, selbst im Alltag.

- Function Creep ist die schrittweise Ausweitung einer Technologie über die ursprünglich beschriebenen Zwecke hinaus. Konkretes Beispiel: Schon jetzt nutzt die rassistische Trump-Regierung ein Arsenal an Überwachungstechnologie auf der Jagd nach Migrant*innen, um sie zu deportieren. Theoretisch könnte Meta die Systeme zur Suche nach Minderjährigen auch zur Suche nach Migrant*innen oder anderen vulnerablen Gruppen einsetzen. Entsprechende Gesetze könnten Konzerne dazu verpflichten, wenn die Infrastruktur erst einmal da ist.

2. Warum macht Meta das?

Meta reagiert mit den neuen Alterskontrollen wahrscheinlich auf die weltweite Debatte um Jugendschutz im Netz und Social-Media-Verbote. Jüngst hat etwa die EU-Kommission festgestellt, dass Meta nicht genug tut, um unter 13-Jährige von Facebook und Instagram fernzuhalten. Das ist ein möglicher Verstoß gegen den DSA; am Ende können Geldbußen drohen.

Die neuen Alterskontrollen könnte der Meta-Konzern als Argument dafür nutzen, dass er sich nun an die Regeln hält. Generell bieten Inferenz-Methoden mehrere Anreize für kommerzielle Online-Plattformen.

- Plattformen wollen ihre Nutzer*innen nicht abschrecken; immerhin ist deren Aufmerksamkeit die wichtigste Geldquelle. Während etwa Ausweiskontrollen für alle eine sichtbare Hürden sind, laufen Inferenz-Methoden zunächst unscheinbar im Hintergrund.

- Inferenz-Methoden basieren auf Wahrscheinlichkeiten. Plattformen können genau steuern, ab welcher Schwelle eines Verdachts die Software Alarm schlägt und von Nutzer*innen eine Altersverifikation verlangt. Auf diese Weise könnte ein Konzern stets optimieren, wie streng die Kontrollen ausfallen – auch mit Blick auf möglichst geringe finanzielle Einbußen.

- Die Systeme hinter Inferenz-Methoden können für Außenstehende komplex und intransparent sein. Kommerzielle Online-Plattformen sprechen gerne davon, dass sie ihre Systeme kontinuierlich verbessern. Das gibt ihnen viel Spielraum, etwaige Fehler zu relativieren mit Verweis auf eine überholte Version der Systeme, etwa gegenüber Aufsichtsbehörden.

3. Ist das neu?

Inferenz-Methoden zur Alterskontrolle auf Online-Plattformen gibt es schon länger. Selbst Meta schreibt, dass sie ihre Systeme lediglich weiter „stärken“. Auch beispielsweise TikTok, ChatGPT, die Google-Suche oder YouTube suchen im Hintergrund nach Hinweisen darauf, ob Nutzer*innen zu jung sein könnten.

Neu ist allerdings die beschriebene Tiefe der Eingriffe – bis hin zur Analyse von Objekten und Knochenstruktur in Bildern und Videos. Wie zur Beschwichtigung betont Meta in der Pressemitteilung: „Das ist keine Gesichtserkennung.“ Die Software identifiziere keine Personen. Das kann technisch korrekt sein, macht die Eingriffe aber nicht unbedenklich.

4. Darf Meta das?

Vielleicht nicht. Die Datenschutzjuristin Kleanthi Sardeli verfolgt die Neuerungen bei Meta jedenfalls mit Skepsis. Sie arbeitet für die spendenfinanzierte NGO noyb („none of your business“) mit Sitz in Wien. Auf Anfrage von netzpolitik.org geht sie darauf ein, dass biometrische Daten wie Knochenstruktur und Körpergröße in der DSGVO einem strengeren Schutz unterliegen.

Knochenstruktur und Körpergröße können als Gesundheitsdaten angesehen werden, die denselben Schutz wie biometrische Daten genießen. Diese dürfen nur in Ausnahmefällen und auf Grundlage spezifischer Rechtsgrundlagen verarbeitet werden. Dazu gehört unter anderem die Einwilligung. In Metas Datenschutzerklärung wird dieser spezifische Einsatzbereich bisher nicht erwähnt, und als Rechtsgrundlage wird lediglich das berechtigte Interesse genannt – was für den Einsatz dieser neuen KI-Technologie eindeutig nicht ausreichend wäre.

Nähere Einschätzungen seien schwierig, schreibt Sardeli. Dafür seien Metas Informationen zu zurückhaltend. „Es wird auch nicht näher erläutert, wie Metas KI-Modelle auf die Alterserkennung trainiert werden – und ob Inhalte auf Meta-Plattformen verwendet werden, um diese KI-Funktionen weiter zu trainieren.“

Scharfe Kritik an Meta kommt von der deutschen Europa-Abgeordneten Alexandra Geese (Grüne), Stellvertretende Vorsitzende im Ausschuss für Binnenmarkt und Verbraucherschutz. Auf Anfrage von netzpolitik.org schreibt sie:

Was Meta hier plant, ist nichts weniger als der nächste Tabubruch: Die systematische Auswertung von Körpermerkmalen wie Knochenstruktur zur Altersbestimmung ist ein massiver Eingriff in hochsensible personenbezogene Daten.

Geese verweist auf eine Regel im DSA, die besagt: Online-Plattformen sind „nicht verpflichtet, zusätzliche personenbezogene Daten zu verarbeiten, um festzustellen, ob der Nutzer minderjährig ist“. Meta tut es dennoch. Statt mehr Schutz reagiere Meta mit mehr Überwachung. „Wer glaubt, man könne Kinderschutz mit biometrischer Massenanalyse erreichen, opfert Grundrechte auf dem Altar eines kaputten Geschäftsmodells.“

5. Was passiert als nächstes?

Die EU-Kommission dürfte sich für das laufende DSA-Verfahren genau anschauen, ob Meta mit den neuen Alterskontrollen die gesetzlichen Vorgaben erfüllt. Einerseits könnte Meta auf diese Weise tatsächlich mehr Minderjährige finden – andererseits könnte die Kommission die datenhungrigen Maßnahmen als unverhältnismäßig einstufen.

Parallel diskutieren Expert*innen gerade auf Deutschland- und EU-Ebene über Maßnahmen für Kinder- und Jugendschutz im Netz. Spitzenpolitiker*innen fordern vehement Social-Media-Verbote und (datensparsame) Alterskontrollen, während Fachleute aus unter anderem Medienpädagogik, Kinderschutz oder IT-Sicherheit vor beidem warnen. Im Sommer sollen die von EU-Kommission und Bundesregierung einberufenen Expert*innen ihre Empfehlungen vorlegen.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Grün-Schwarz will in Baden-Württemberg als erstem Bundesland doppelte KI-Videoüberwachung ausrollen: Kameras, die Menschen auf verdächtiges Verhalten überprüfen und sie gleichzeitig mit Gesichtserkennung analysieren. In Mannheim und zwei weiteren Städten soll das Pilotprojekt starten.

Gestern haben Cem Özdemir und Manuel Hagel den grün-schwarzen Koalitionsvertrag für Baden-Württemberg vorgestellt. Hier sollen demnach erstmals in Deutschland Kameras eingesetzt werden, die sowohl das Verhalten der Abgebildeten analysieren und bewerten, als auch deren Gesichter vermessen, um per Gesichtserkennung herauszufinden, ob sie von polizeilichem Interesse sind.

Die Verhaltenskontrolle wird bereits seit acht Jahren in Mannheim trainiert. Das Modellprojekt soll nun räumlich ausgeweitet werden, auf zwei weitere, bislang ungenannte Städte. Auch der Umfang wird erweitert, denn zusätzlich zur Verhaltenserkennungs-Technologie sollen künftig auch Objekte und Gesichter von den Kameras erkannt werden.

Live-Gesichtserkennung läuft in Deutschland bislang nur in Frankfurt am Main hinter öffentlichen Überwachungskameras. Die Software vermisst jedes Gesicht im Erfassungsbereich und schlägt Alarm, sobald es einem gesuchten Gesicht sehr ähnlich ist. Gesucht wird damit nach Terrorist*innen, nach vermissten Menschen, nach Opfern von Entführung, Menschenhandel oder sexueller Ausbeutung. Analysiert und mit den Polizeidatenbanken abgeglichen wird aber jedes Gesicht, das die Kameras aufnehmen.

Zusätzlich zur Echtzeit-Fernidentifizierung wollen Grüne und CDU der Polizei in Baden-Württemberg auch die Suche nach bestimmten Gesichtern im Internet erlauben. Auf Bundesebene gibt es aktuell ebenfalls Bestrebungen, das Tool einzuführen. Damit können Beamt*innen beispielsweise Menschen auf Social Media finden, etwa auf Bildern, die Vereine oder Arbeitgeber ins Netz stellen. Selbst auf Totalaufnahmen von Großveranstaltungen könnten Personen gefunden werden. Wenn die Verhaltensanalyse in einer der Pilotstädte eine Straftat detektiert, kann damit theoretisch auch die tatverdächtige Person retrograd identifiziert werden.

„Schonung der Grundrechte“

Für die Echtzeit-Fernidentifizierung und die Gesichtersuchmaschine muss die Koalition das Polizeigesetz von Baden-Württemberg ändern. Dabei hatte Grün-Schwarz das erst Ende vergangenen Jahres getan. Damals hatte die Landesregierung der Polizei Datenanalyse nach Palantir-Art erlaubt, die diese ohnehin schon lange betrieb. Außerdem genehmigten die alten und neuen Koalitionspartner der Polizei auch das KI-Training mit den persönlichen Daten von Bürger*innen sowie die Weitergabe dieser an externe Stellen.

Nun soll also eine neue Polizeigesetznovelle kommen, die auch Echtzeit-Fernidentifizierung ermöglicht. Niedersachsen, Sachsen und Schleswig-Holstein sind ebenfalls daran, Gesetzesgrundlagen dafür einzuführen. Die Technologie ist in Sicherheitsbehörden ziemlich beliebt, genauso wie der Verhaltensscanner, der in Mannheim trainiert wird. Vergangenes Jahr hat ihn Hamburg übernommen, Berlin folgt wohl als nächstes, Hessen, Niedersachsen, Sachsen, Schleswig-Holstein und Thüringen haben bereits Rechtsgrundlagen dafür oder arbeiten daran.

Bislang hat sich noch niemand getraut, beide Technologien auf einmal einzusetzen. Die Datenschutzbedenken sind bei beiden allein schon sehr hoch. In Baden-Württemberg gibt es nun aber scheinbar keine Scheu mehr. „KI-Videoschutz kann für mehr Sicherheit bei gleichzeitiger Schonung der Grundrechte sorgen“, schreiben Grüne und CDU in ihrem Koalitionsvertrag.

Dass es bei den drei Standorten bleibt, an denen die Koalition die multiple KI-Überwachung pilotieren will, ist vermutlich eher unrealistisch. Bereits vor der Wahl hatten sich Özdemir und Hagel dazu bekannt, den Einsatz von Videoüberwachungskameras entgrenzen zu wollen. Für den Einsatz soll keine erhöhte Kriminalitätsbelastung mehr nötig sein, die Kommunen sollen freihändig darüber entscheiden.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

Die europäische Polizeibehörde Europol hat offenbar jahrelang eine Schatten-IT betrieben. Mitarbeitende sollen damit widerrechtlich große Mengen an personenbezogenen Daten durchsucht und ausgewertet haben. Dennoch will die EU-Kommission Europol nun mit deutlich mehr Budget und Personal ausstatten.